室谷

室谷今回はClaude CodeとOllamaの連携をテーマにしましょう。これ、.AI(ドットエーアイ)コミュニティでもかなり話題になってまして・・・「Claude Codeを無料で使い続けたい」という声、めちゃくちゃ多いんですよね。

テキトー教師

テキトー教師ですよね。講座でもよく出るんですよ、「月$20払い続けるのがしんどい」「使いすぎてレートリミットに引っかかる」という悩みが。

Ollamaとの組み合わせはその解決策として注目されています。

Ollamaとの組み合わせはその解決策として注目されています。

室谷

室谷Ollamaが2026年1月にAnthropicのMessages APIと互換性を持つアップデートを出して、Claude CodeがローカルLLMで動かせるようになったんですよね。さらに

ollama launch claudeコマンドが追加されて、環境変数の設定すら不要になった。 テキトー教師

テキトー教師このあたりの変化が速すぎて、ネット上の古い情報で「できなかった」と諦めている人が多いんですよ。実際には2026年に入ってから大きく変わりました。

今回は最新の状況を整理していきましょう。

今回は最新の状況を整理していきましょう。

室谷

室谷構成としては、Ollamaとは何か、Claude Codeとの連携方法、どのモデルを選ぶか、そして実用上のポイントという順番で話していきましょう。

Ollamaとは?Claude Codeとの関係

テキトー教師

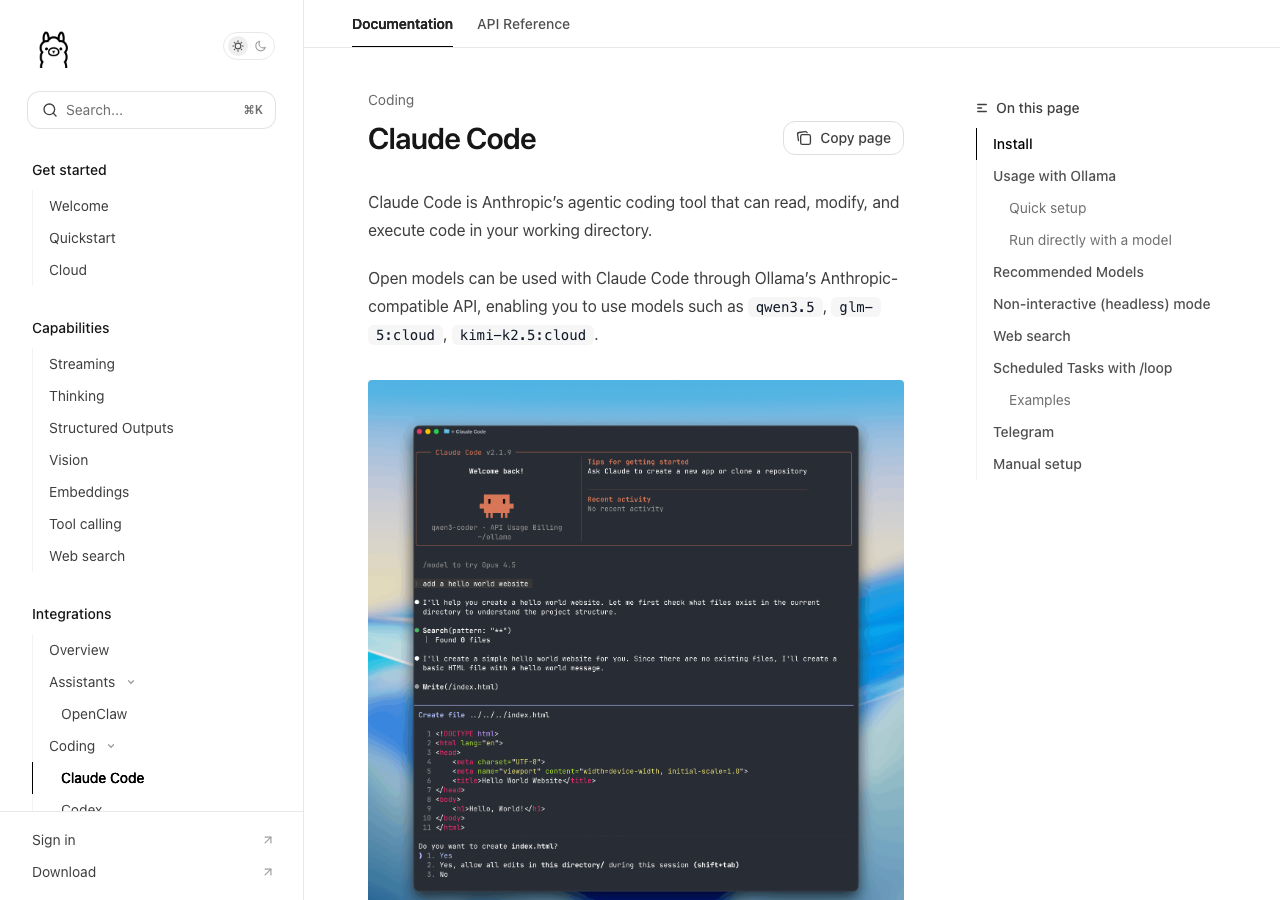

テキトー教師まずOllamaを知らない方向けに説明しておきますね。Ollamaは、Llama系やQwen系などのオープンソースLLMをローカル環境で動かすためのツールです。

公式サイト()からダウンロードできて、Macなら

公式サイト()からダウンロードできて、Macなら

brew install ollamaでも入ります。あとはモデル名を指定して実行するだけ。 室谷

室谷特徴的なのは、OpenAI APIと互換性のあるAPIサーバーを立ち上げてくれるんですよ。これで「OpenAI APIに対応しているツールならOllamaで代替できる」というのが基本的な考え方でした。

そこに2026年1月、Anthropic Messages APIとの互換性が追加された。

そこに2026年1月、Anthropic Messages APIとの互換性が追加された。

テキトー教師

テキトー教師つまり、Claude Codeが「Anthropicにリクエストを送る」ところを「OllamaのAPIサーバーにリクエストを送る」に切り替えられるようになったわけです。モデルはQwenやGLM、Kimi、MiniMaxなどのオープンソースモデル。

APIキーも課金もありません。

APIキーも課金もありません。

室谷

室谷ただここは正直に言うと、Claude本体とOllamaのオープンモデルでは性能差があります。複雑なリファクタリングや大規模なコードベースの把握は、やはりClaude本体の方が精度が高い。

でも「ちょっとしたスクリプトを書く」「繰り返し作業を自動化する」用途ならローカルLLMで十分だというのが実感です。

でも「ちょっとしたスクリプトを書く」「繰り返し作業を自動化する」用途ならローカルLLMで十分だというのが実感です。

テキトー教師

テキトー教師そのトレードオフを理解した上で使うのが大前提ですね。「完全に無料でClaudeと同じ体験を」というのは期待しすぎで、「Claude Codeのインターフェースとワークフローを活用しながら、簡単なタスクをこなす」というイメージが正確です。

OllamaでClaude Codeを動かす方法

室谷

室谷では実際の設定方法を見ていきましょう。2026年現在、最も簡単な方法は

環境変数を自分で設定する必要がない。

ollama launch claudeコマンドを使うやり方です。環境変数を自分で設定する必要がない。

テキトー教師

テキトー教師順番に説明しますね。まずOllamaをインストールするところから。

Ollamaのインストール

室谷

室谷インストールは公式サイト()からダウンロードするか、ターミナルで以下を実行します。

macOS / Linux:

curl -fsSL https://ollama.com/install.sh | sh

Windowsはインストーラーをダウンロードして実行します。OllamaはmacOS、Windows、Linux全対応です。

テキトー教師

テキトー教師インストール後、

ollamaコマンドが使えるようになります。ollamaとだけ打つと対話式メニューが出て、モデルの選択やClaude Codeの起動もここからできます。Claude Codeのインストール

室谷

室谷Claude Code本体もインストールが必要です。

curl -fsSL https://claude.ai/install.sh | bash

これでClaude Codeがインストールされます。npmでのインストール(npm install -g @anthropic-ai/claude-code)も使えますが、現在は公式スクリプトが推奨です。Claude Codeのインストール方法については別記事(#92)で詳しく解説していますが、今回はOllamaとの連携に絞って進めましょう。

ollama launch claudeでワンコマンド起動(推奨)

テキトー教師

テキトー教師2026年1月に追加された

ollama launchコマンドが、最も簡単な方法です。環境変数を一切設定しなくていい。ollama launch claude

このコマンドを実行すると、Ollamaが自動的に推奨モデルを選択してClaude Codeを起動します。

室谷

室谷モデルを指定したい場合は

--modelフラグを使います。ollama launch claude --model kimi-k2.5:cloud

テキトー教師

テキトー教師:cloudがついているのはOllamaのクラウドモデルです。OllamaのサーバーでGPU処理するので、ローカルPCのスペックに関係なく動くのがポイント。Ollamaの無料アカウントで使えますが、利用制限があります。

室谷

室谷CI/CDやDockerで使うヘッドレス(非対話)モードも用意されています。

ollama launch claude --model kimi-k2.5:cloud --yes -- -p "このリポジトリの構成を説明してください"

--yesフラグを付けると、モデルの確認をスキップして自動的に起動します。--以降の引数はClaude Codeに渡されます。

手動設定(環境変数を使う方法)

テキトー教師

テキトー教師ollama launchを使わずに、環境変数で細かく制御する方法もあります。export ANTHROPIC_AUTH_TOKEN=ollama

export ANTHROPIC_API_KEY=""

export ANTHROPIC_BASE_URL=http://localhost:11434

claude --model qwen3.5

もしくはインラインで指定する方法も使えます。

ANTHROPIC_AUTH_TOKEN=ollama ANTHROPIC_BASE_URL=http://localhost:11434 ANTHROPIC_API_KEY="" claude --model glm-5:cloud

室谷

室谷ここで重要なのは3つの環境変数です。

ANTHROPIC_BASE_URLでリクエスト先をOllamaのローカルサーバー(デフォルトでhttp://localhost:11434)に向ける。ANTHROPIC_AUTH_TOKEN=ollamaはOllama向けの認証設定です。ANTHROPIC_API_KEYは空にしておきます。 テキトー教師

テキトー教師設定ファイルに書いておきたい場合は、

.bashrcや.zshrcにexportを追加しておくと毎回設定しなくて済みます。ただし本物のAnthropicのAPIキーと混在しないよう注意が必要です。推奨モデルと選び方

室谷

室谷どのモデルを使うかが実際の使い勝手を大きく左右します。Ollamaの公式ドキュメントでは以下のモデルを推奨しています。

| モデル名 | 種類 | 特徴 |

|---|---|---|

| kimi-k2.5:cloud | クラウド | コーディング特化、大きなコンテキスト |

| glm-5:cloud | クラウド | バランスが良い、ツール呼び出し対応 |

| minimax-m2.7:cloud | クラウド | コーディング・エージェント向け |

| qwen3.5:cloud | クラウド | マルチモーダル対応 |

| glm-4.7-flash | ローカル | GPUなしでも動く軽量モデル |

| qwen3.5 | ローカル | オールラウンド、各サイズあり |

テキトー教師

テキトー教師クラウドモデルとローカルモデルの違いを整理しておくと、クラウドモデルはOllamaのサーバーでGPU処理するのでPCスペック不問。Ollamaの無料プランにも含まれますが、利用制限があります(無料プランはライトな利用向け、Proプランで日常作業量に対応)。

ローカルモデルは自分のPCで動かすので制限なしですが、VRAMが必要です。

ローカルモデルは自分のPCで動かすので制限なしですが、VRAMが必要です。

室谷

室谷MYUUUのエンジニアが試した感触だと、コーディング用途ならkimi-k2.5かglm-5がいいですね。ツール呼び出し(Claude Codeがファイルを読み書きする機能)がちゃんと動くのが条件で、この2つは安定しています。

テキトー教師

テキトー教師コーディング用途でClaude Codeと組み合わせる場合、コンテキストウィンドウのサイズが重要です。Ollamaの公式ドキュメントでは「最低64,000トークン(64k)以上を推奨」とされています。

クラウドモデルはデフォルトで最大コンテキスト長に設定されているので心配いりません。

クラウドモデルはデフォルトで最大コンテキスト長に設定されているので心配いりません。

ローカルモデルのコンテキスト長設定

室谷

室谷ローカルモデルを使う場合、デフォルトのコンテキスト長がVRAM量によって自動調整されます。

- VRAM 24GB未満: 4k(コーディングには不足)

- VRAM 24〜48GB: 32k

- VRAM 48GB以上: 256k

テキトー教師

テキトー教師多くの人はVRAM 24GB未満なので、この場合はコンテキスト長を手動で拡張する必要があります。

OLLAMA_CONTEXT_LENGTH=64000 ollama serve

この環境変数でOllamaサーバーを起動すると、コンテキスト長が64kになります。実際に使用中のコンテキスト長はollama psコマンドで確認できます。

ollama ps

# NAME ID SIZE PROCESSOR CONTEXT UNTIL

# qwen3.5:latest a2af6cc3eb7f 6.6 GB 100% GPU 65536 2 minutes from now

室谷

室谷コンテキスト長を広げるとその分メモリ消費も増えるので、PCのスペックと相談しながら設定してください。

Ollamaのプロキシ・API構成

テキトー教師

テキトー教師claude code ollama proxyと調べる方も多いので、プロキシ構成についても説明しておきますね。 室谷

室谷Ollamaが提供するAnthropic互換APIは、

http://localhost:11434で動いています。これ自体がプロキシとして機能していて、Claude Codeのリクエストを受け取ってOllamaのモデルに転送します。 テキトー教師

テキトー教師つまり、

Ollamaをインストールして起動するだけで、ローカルプロキシが動きます。

ANTHROPIC_BASE_URL=http://localhost:11434という設定が「プロキシの設定」に相当します。外部のプロキシサーバーは特に必要ありません。Ollamaをインストールして起動するだけで、ローカルプロキシが動きます。

室谷

室谷チームで共有するケースもありますよね。例えば社内ネットワーク上の1台のマシンにOllamaをセットアップして、他のメンバーがそのOllamaサーバーに繋ぐ構成。

その場合は

その場合は

ANTHROPIC_BASE_URLをhttp://{OllamaマシンのIPアドレス}:11434に変えるだけです。 テキトー教師

テキトー教師この構成だと、GPU搭載のワークステーションを1台用意してチーム全員がそこにリクエストを飛ばす、みたいな運用もできます。Ollamaのサンドボックス機能や権限管理は別途考慮が必要ですが。

Claude CodeとOllamaのMCP連携

室谷

室谷claude code ollama mcpという検索も多いですよね。MCPを使ったOllamaとの連携についても触れておきましょう。 テキトー教師

テキトー教師MCP(Model Context Protocol)はClaude Codeにツールを追加するプロトコルです。通常の使い方ではOllamaとMCPを直接組み合わせることはあまりないんですが、活用シーンはあります。

室谷

室谷例えば「Claude CodeのバックエンドモデルをローカルのOllamaに向けつつ、MCPでファイルシステムや外部APIにアクセスする」という構成は普通に動きます。MCPの設定は独立しているので、

ANTHROPIC_BASE_URLをOllamaに向けていても、MCPのツールはそのまま機能します。 テキトー教師

テキトー教師コミュニティのメンバーさんで実際に試していた方がいて、MCPでNotion連携しながらバックエンドをOllamaにしていた、という話を聞きました。ちょっとしたドキュメント整理作業だと全然使えるって言っていましたね。

室谷

室谷MCPの詳しい設定はにまとめてあるので、MCPを組み合わせたい方はそちらを参照してください。

Ollamaのクラウドモデルとプランの話

テキトー教師

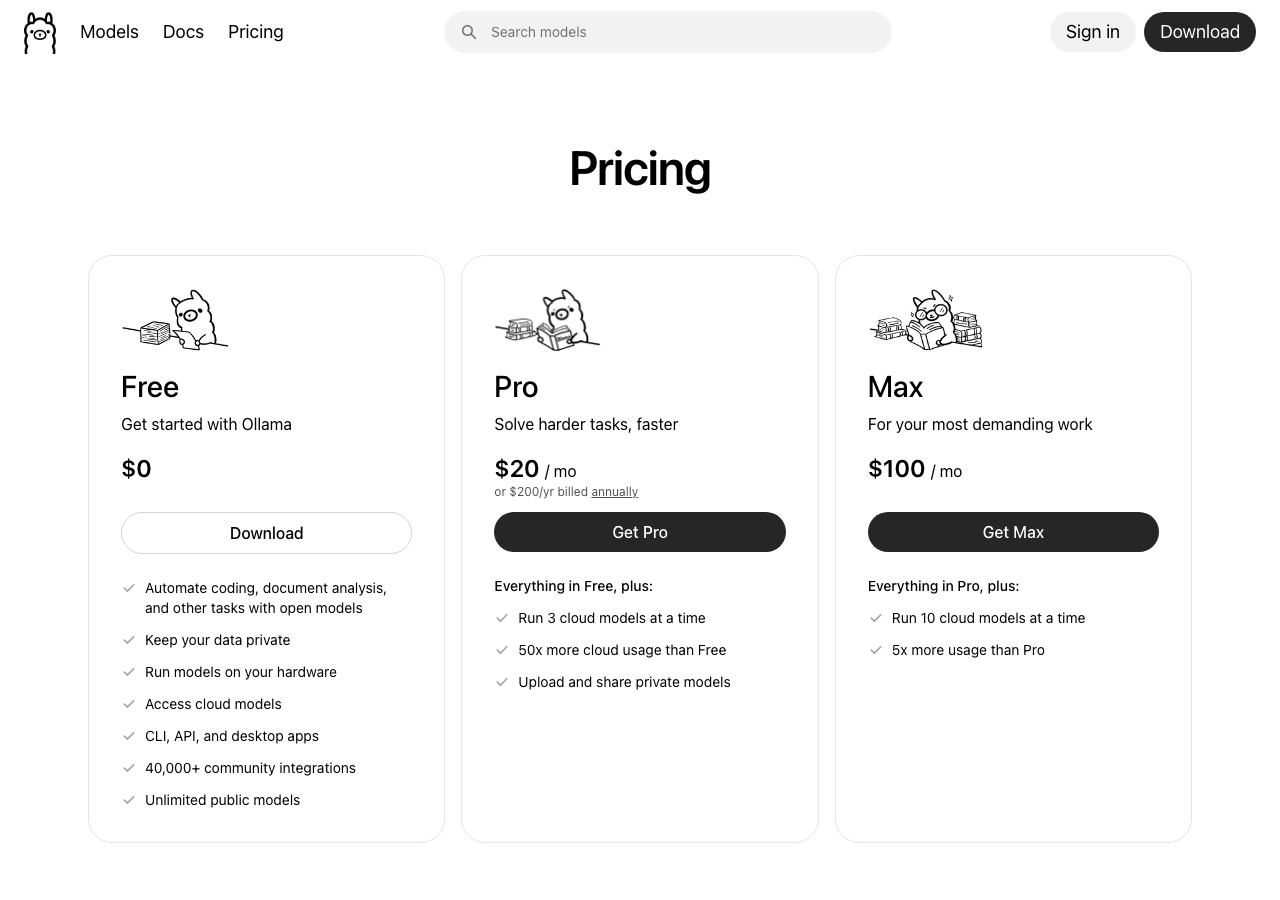

テキトー教師Ollamaには有料プランもあるので、その話も整理しておきましょう。

室谷

室谷Ollamaは2026年時点で以下のプランを提供しています。

| プラン | 月額 | クラウドモデル | 使用量 |

|---|---|---|---|

| Free | $0 | 利用可 | 軽い利用向け |

| Pro | $20/月 | 3モデル同時 | 日常作業に対応(Freeの50倍) |

| Max | $100/月 | 10モデル同時 | 重い継続的な利用に対応 |

テキトー教師

テキトー教師Anthropicのプランと比較すると、Ollamaはモデルの性能は劣りますが、ローカル実行は完全無制限なのが強みです。クラウドモデルも使いたいならFreeかProという選択になります。

室谷

室谷面白いのは「ローカルで動かすのは完全無制限」という設計ですね。自分のGPUで回すなら無課金で使い続けられます。

GPU持ってる人にとってはかなり魅力的な選択肢です。

GPU持ってる人にとってはかなり魅力的な選択肢です。

テキトー教師

テキトー教師Proプランの$20/月はAnthropicのProと同額なんですよね。モデル性能はAnthropicが上ですが、プライバシー面でローカル実行にこだわりがある方や、データをクラウドに送りたくないケースではOllamaが有利です。

Claude CodeとOllamaを使う際の注意点

室谷

室谷実際に使ってみると出てくるいくつかのポイントをまとめておきましょう。

テキトー教師

テキトー教師まず「ローカルLLMでClaude Codeを使えばAnthropicと全く同じ体験になる」は期待しすぎです。いくつかの制限があります。

ツール呼び出しの精度

室谷

室谷Claude Codeのコアな機能は「ファイルを読んで、コードを書いて、実行する」というツール呼び出しの連鎖です。Claude本体はこれが非常に安定していますが、オープンモデルはモデルによってばらつきがあります。

テキトー教師

テキトー教師推奨モデル(kimi-k2.5、glm-5等)はツール呼び出しに対応して動作確認されていますが、独自に別のモデルを試した場合は動作が保証されません。「ツールを呼ばずに答えだけ返す」「ツールの引数フォーマットがずれる」といった問題が出ることがあります。

よくあるエラーと対処法

室谷

室谷設定していてハマるポイントをまとめておきます。

- 404エラーが出る:

ANTHROPIC_BASE_URLの末尾に/v1が入っていると失敗します。http://localhost:11434と書いてください(/v1不要) - モデルが見つからない: モデル名を

claude --modelで指定する際、Ollamaに存在するモデル名を指定してください。ollama listで確認できます - レスポンスが返ってこない: コンテキスト長が不足している可能性があります。

OLLAMA_CONTEXT_LENGTH=64000 ollama serveで再起動してみてください - 接続できない: Ollamaが起動していない可能性があります。

ollama serveコマンドで起動を確認してください

テキトー教師

テキトー教師claude code ollama not workingで調べると出てくるケースの多くが、URLの末尾に余計なパスが入っているケースです。公式ドキュメント通りhttp://localhost:11434のみにしてください。Windows(WSL)での注意

室谷

室谷WindowsでOllamaを使う場合の補足もしておきましょう。

claude code ollama windowsという方も多いですよね。 テキトー教師

テキトー教師WindowsはネイティブにOllamaをインストールできます(WSL不要)。Claude CodeはWSL環境で動かすことが多いので、その場合はWSL内から

http://localhost:11434に接続できます。 室谷

室谷WSL2内からWindowsのOllamaに接続する場合は、

localhostではなくhttp://host.docker.internal:11434またはhttp://$(hostname -I | awk '{print $1}'):11434をANTHROPIC_BASE_URLに設定する必要があります。 テキトー教師

テキトー教師WSL内の

localhostはWindowsのlocalhostとは別のネットワーク空間になっています。ここがハマりポイントになりやすいので注意してください。Ollamaを使ったローカルLLMの実力は?

室谷

室谷結局のところ「claude code local llm」でどれだけの仕事ができるか、というのが一番気になるところですよね。

テキトー教師

テキトー教師正直に言うと、「簡単なスクリプト作成」「定型的なリファクタリング」「ドキュメントの雛形作成」あたりなら十分使えます。でも「既存の大規模コードベースを理解してバグを直す」「複雑なアーキテクチャの設計」は難しい。

室谷

室谷MYUUUのエンジニアに聞いた話だと、「Claude Codeのプロンプトやワークフローを練習する場として使っている」という使い方が結構あるんですよね。本番の難しいタスクはAnthropicのClaude本体に任せて、プロンプトのテストやデバッグフローの確認をOllamaでやると。

その使い方はかなり合理的だと思います。

その使い方はかなり合理的だと思います。

テキトー教師

テキトー教師教える立場から言うと、Claude Codeの操作方法を学ぶ段階でOllamaを使うのはアリです。課金を気にせず試行錯誤できるので。

「どんなプロンプトを渡せばいいか」「CLAUDE.mdにどう書けばいいか」を探る段階では十分機能します。

「どんなプロンプトを渡せばいいか」「CLAUDE.mdにどう書けばいいか」を探る段階では十分機能します。

室谷

室谷あとはプライバシーの観点ですね。社内の機密コードを外部のAPIに送りたくないケースでは、Ollamaのローカルモデルは有効な選択肢です。

性能は落ちますが、コードが外に出ないというのは一定の価値があります。

性能は落ちますが、コードが外に出ないというのは一定の価値があります。

よくある質問(FAQ)

claude codeをollamaで使う場合、Anthropicのアカウントは不要ですか?

テキトー教師

テキトー教師Ollamaへの接続のみであれば、AnthropicのAPIキーもアカウントも不要です。

ただしClaude Code自体のインストールにはインターネット接続が必要です。

ANTHROPIC_API_KEY=""(空文字)を設定することでClaude Codeの認証をバイパスできます。ただしClaude Code自体のインストールにはインターネット接続が必要です。

claude code ollamaでウェブ検索は使えますか?

室谷

室谷Ollamaのウェブ検索機能とClaude Codeを組み合わせることが可能です。Ollamaの公式ドキュメントでは、ウェブ検索APIのセットアップと使い方が解説されています。

ウェブ検索が必要なタスクでは、モデルがウェブ検索ツールを呼び出して情報を取得できます。

ウェブ検索が必要なタスクでは、モデルがウェブ検索ツールを呼び出して情報を取得できます。

claude code ollama alternativeとして他に何がありますか?

テキトー教師

テキトー教師ローカルLLMでClaude Codeを使う方法として、Ollamaの他に「LM Studio」という選択肢もあります。LM Studioも

UIが使いやすいので、初心者にはLM Studioも検討に値します。

ANTHROPIC_BASE_URLを設定することでClaude Codeと接続できます。UIが使いやすいので、初心者にはLM Studioも検討に値します。

室谷

室谷ただし2026年時点でClaude Codeとの公式な統合を提供しているのはOllamaだけです。

ollama launch claudeコマンドのような便利な統合はOllamaならではの機能です。プロキシ経由で企業ネットワークから使う場合は?

テキトー教師

テキトー教師企業のネットワークプロキシを経由してOllamaに接続する場合は、

HTTPS_PROXYやHTTP_PROXY環境変数を設定します。OllamaのAPIサーバーへの接続自体はHTTPなので、通常のHTTPプロキシ設定が使えます。まとめ

室谷

室谷今回のポイントを整理しておきましょう。Claude CodeとOllamaの連携は、2026年1月のOllamaアップデートから公式サポートになっていて、

ollama launch claudeというコマンドでワンコマンド起動できるようになっています。 テキトー教師

テキトー教師こういう使い方に向いています。

- 料金を気にせずClaude Codeの操作を練習したい

- 簡単なスクリプト作成・自動化タスクをこなしたい

- プライバシー上の理由でコードを外部に送りたくない

- CI/CDやDockerで自動化パイプラインに組み込みたい

室谷

室谷逆に「複雑なコードベースをClaudeに理解させて大規模な改修をしたい」「精度の高い出力が必要な本番タスク」には、やはりAnthropicのClaude本体を使うべきです。

テキトー教師

テキトー教師使い分けが鍵ですね。両方の特性を理解した上で、タスクに応じて切り替えるのが一番賢い使い方だと思います。

Claude Codeの操作感はOllamaでも同じなので、慣れてから本番環境に移行するのもスムーズにできます。

Claude Codeの操作感はOllamaでも同じなので、慣れてから本番環境に移行するのもスムーズにできます。

室谷

室谷OllamaとClaude Codeの組み合わせは、まだ進化中の分野です。2026年2月にサブエージェントとウェブ検索のサポートも追加されていて、機能は増え続けています。

公式ドキュメント()を定期的にチェックすることをおすすめします。

公式ドキュメント()を定期的にチェックすることをおすすめします。