Claude Codeをローカルで動かせるって本当?Ollama・llama.cpp・LiteLLMの全セットアップ手順【2026年最新】

室谷

室谷 テキトー教師

テキトー教師実際に講座でも聞かれますし。ただ、ローカルLLMでClaude Codeを動かすのは「Claudeモデルそのものをローカルに持ってくる」わけじゃない点を最初に整理した方がいいですね。

室谷

室谷「Claude Codeというツール(シェル)を、OllamaやLlama.cppなどのローカルLLMサーバーに向けて動かす」という構成になります。

テキトー教師

テキトー教師- 通常のClaude Code: Claude Codeツール → Anthropic APIサーバー → Claudeモデル

- ローカルLLM接続: Claude Codeツール → ローカルサーバー(Ollama等) → Qwen・Gemmaなどのオープンモデル

室谷

室谷課金はゼロ。ただしClaude(Anthropicのモデル)を使っているわけではないので、性能は当然変わります。

テキトー教師

テキトー教師 室谷

室谷どちらが向いているかは、この記事を読んでいただければわかると思います。

ローカルLLMでClaude Codeを使うメリット・デメリット

テキトー教師

テキトー教師 室谷

室谷APIコストを気にせずガンガン試せるのは大きいですよね。

テキトー教師

テキトー教師2026年3月にAnthropicが複数回の障害を出したんですが、そういうときでもローカルなら関係ないです。

室谷

室谷機密性の高いコードを扱うときは特に。

テキトー教師

テキトー教師現在のローカルモデルでClaude Sonnetと同等のコーディング性能を出すのは難しいです。

室谷

室谷8GB RAMだと厳しいことが多いです。

テキトー教師

テキトー教師ローカルLLM実行に必要なハードウェア

室谷

室谷 テキトー教師

テキトー教師| 構成 | 使えるモデルサイズ | 速度感 |

|---|---|---|

| 8GB RAM(CPU推論) | 3B〜7Bモデルが限界 | 非常に遅い(実用困難) |

| 16GB RAM(CPU推論) | 7B〜9Bモデル | 遅め(試用レベル) |

| M1/M2/M3 Mac 16GB | 9B〜14Bモデル | 実用的(Apple Siliconの統合メモリが効く) |

| M3/M4 Mac 24GB〜 | 27B〜35Bモデル | 快適 |

| VRAM 12GB(GPU) | 14Bモデル | 快適 |

| VRAM 24GB(GPU) | 32B〜35Bモデル | 快適 |

| VRAM 48GB〜 | 70Bモデル以上 | 快適 |

室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師Ollamaを使ったセットアップ(最速・おすすめ)

室谷

室谷「claude code ローカル 実行」で一番最初にたどり着く方法ですね。

テキトー教師

テキトー教師 室谷

室谷Macならdmgファイル、Linuxはシェルスクリプト一発。

テキトー教師

テキトー教師「claude code ローカル モデル」として何を選べばいいかという話ですが、2026年現在のおすすめはQwen3.5です。

室谷

室谷 テキトー教師

テキトー教師- メモリ16GB以下: qwen3.5:9b(約6GB)

- メモリ16GB〜24GB: qwen3.5:14b(約9GB)

- メモリ24GB以上: qwen3.5:32b(約20GB)

室谷

室谷# モデルのダウンロード(例: Qwen3.5 9Bモデル)

ollama pull qwen3.5:9b

# サーバーが自動起動していない場合

ollama serve

テキトー教師

テキトー教師http://localhost:11434でOpenAI互換のAPIエンドポイントが立ち上がります。 室谷

室谷# ローカルのOllamaサーバーに向ける

export ANTHROPIC_BASE_URL=http://localhost:11434

# ダミーのAPIキー(ローカルサーバーなので何でもOK)

export ANTHROPIC_API_KEY=sk-dummy-key

テキトー教師

テキトー教師cd /your/project

claude --model qwen3.5:latest

室谷

室谷--modelオプションでモデル名を明示的に指定するのが確実です。OllamaはOpenAI互換APIなのでClaude Codeがそのまま使えます。ここが設計としてうまいなと思いますよね・・・。

テキトー教師

テキトー教師~/.zshrcか~/.bashrcに追記しておくといいですよ。# ~/.zshrc に追記

export ANTHROPIC_BASE_URL=http://localhost:11434

export ANTHROPIC_API_KEY=sk-dummy-key

室谷

室谷unset ANTHROPIC_BASE_URLしてください。設定したままClaudeモデルを使おうとすると接続エラーになります。

テキトー教師

テキトー教師llama.cppを使った高度なセットアップ

室谷

室谷 テキトー教師

テキトー教師 室谷

室谷# 依存関係のインストール

apt-get update

apt-get install pciutils build-essential cmake curl libcurl4-openssl-dev git-all -y

# llama.cppのビルド(CUDA GPU使用の場合)

git clone https://github.com/ggml-org/llama.cpp

cmake llama.cpp -B llama.cpp/build \

-DBUILD_SHARED_LIBS=OFF -DGGML_CUDA=ON

cmake --build llama.cpp/build --config Release -j --clean-first \

--target llama-cli llama-server

cp llama.cpp/build/bin/llama-* llama.cpp

テキトー教師

テキトー教師-DGGML_CUDA=OFFにするだけで、Metal(GPU)のサポートは自動で有効になります。 室谷

室谷pip install huggingface_hub hf_transfer

# Qwen3.5-35B-A3B(MoE版・24GB VRAMに収まるサイズ)

hf download unsloth/Qwen3.5-35B-A3B-GGUF \

--local-dir unsloth/Qwen3.5-35B-A3B-GGUF \

--include "*UD-Q4_K_XL*"

テキトー教師

テキトー教師UD-Q4_K_XLは量子化精度の指定です。4bit量子化で、サイズと精度のバランスが良いと言われています。 室谷

室谷./llama.cpp/llama-server \

--model unsloth/Qwen3.5-35B-A3B-GGUF/Qwen3.5-35B-A3B-UD-Q4_K_XL.gguf \

--alias "qwen3.5:35b" \

--temp 0.6 \

--top-p 0.95 \

--top-k 20 \

--port 8001 \

--ctx-size 131072

テキトー教師

テキトー教師--ctx-size 131072は131Kトークンのコンテキスト長を意味します。コードベースが大きい場合はここを増やすと良いですが、VRAMをより多く使います。 室谷

室谷export ANTHROPIC_BASE_URL=http://localhost:8001

export ANTHROPIC_API_KEY=sk-dummy-key

テキトー教師

テキトー教師 室谷

室谷~/.claude/settings.jsonに以下を追加するだけで解決します。{

"env": {

"CLAUDE_CODE_ATTRIBUTION_HEADER": "0"

}

}

テキトー教師

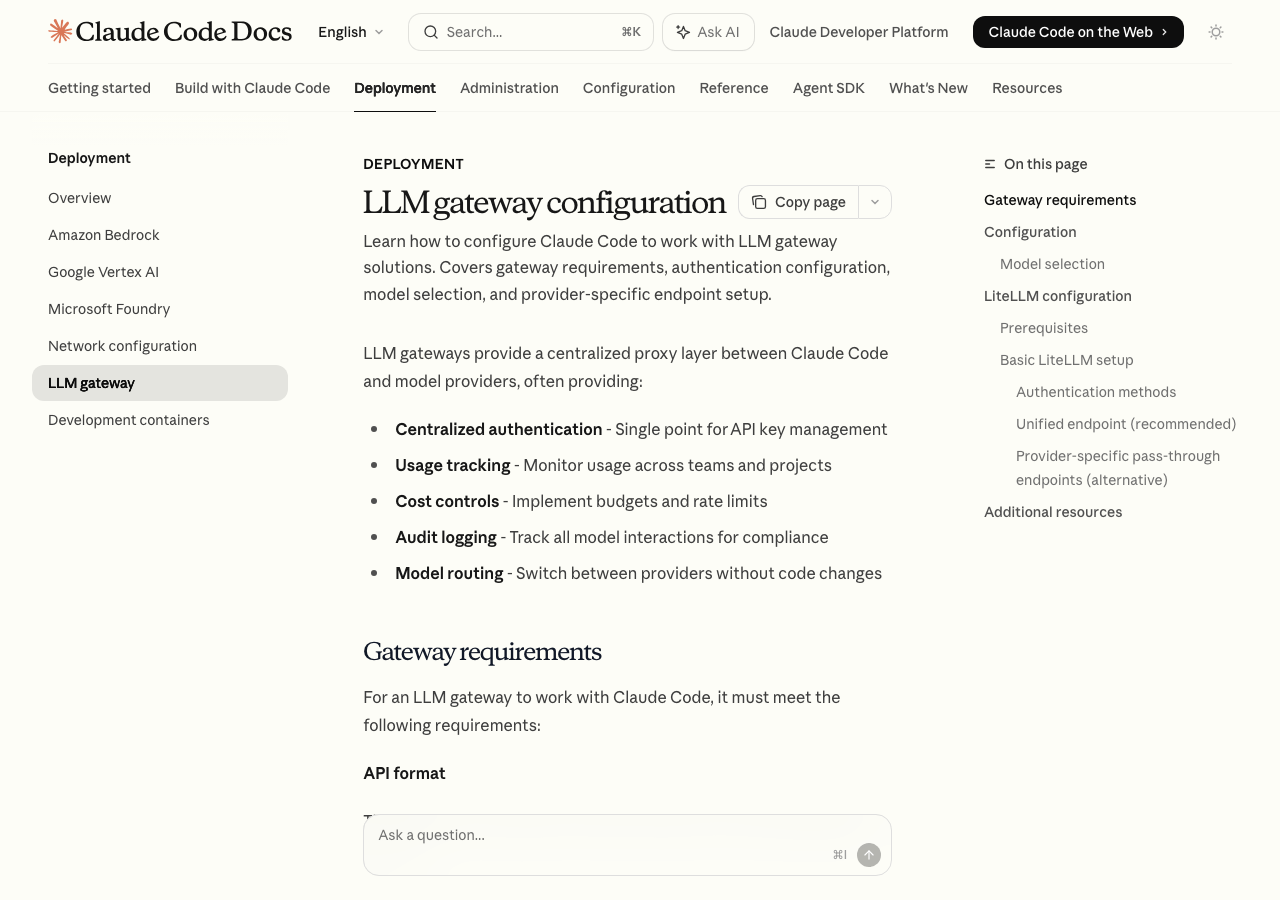

テキトー教師export CLAUDE_CODE_ATTRIBUTION_HEADER=0としても効かないので、settings.jsonに書く必要があります。ここはハマりポイントなので覚えておいてください。LiteLLMを経由した接続

室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師これらのバージョンはインストールしないでください。

室谷

室谷 テキトー教師

テキトー教師# LiteLLMのデフォルトポートは4000

export ANTHROPIC_BASE_URL=http://localhost:4000

export ANTHROPIC_AUTH_TOKEN=sk-litellm-your-key

室谷

室谷MYUUUでも将来的にこういう構成を考えています。

おすすめのローカルモデル比較(2026年4月時点)

テキトー教師

テキトー教師 室谷

室谷| モデル | パラメータ | 必要メモリ目安 | コーディング性能 |

|---|---|---|---|

| Qwen3.5-35B-A3B(MoE) | 35B(実効3B) | VRAM/RAM 24GB | 高い(おすすめ) |

| Qwen3.5-27B | 27B | VRAM/RAM 18GB〜 | 高い |

| Qwen3.5-14B | 14B | VRAM/RAM 10GB〜 | 中〜高 |

| Qwen3.5-9B | 9B | VRAM/RAM 7GB〜 | 中 |

| GLM-4.7-Flash | 7B | VRAM/RAM 5GB〜 | 中 |

| Devstral | 24B | VRAM/RAM 16GB〜 | 高い(コード特化) |

テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師Windows環境でのローカル設定

室谷

室谷 テキトー教師

テキトー教師# 現在のセッションのみ有効

$env:ANTHROPIC_BASE_URL = "http://localhost:11434"

$env:ANTHROPIC_API_KEY = "sk-dummy-key"

# 永続化する場合

setx ANTHROPIC_BASE_URL "http://localhost:11434"

setx ANTHROPIC_API_KEY "sk-dummy-key"

室谷

室谷 テキトー教師

テキトー教師よくある問題とトラブルシューティング

室谷

室谷 テキトー教師

テキトー教師ANTHROPIC_BASE_URLを設定したままローカルサーバーが起動していないときに起きます。# Ollamaが起動しているか確認

curl http://localhost:11434/api/tags

# 起動していない場合

ollama serve

室谷

室谷# ローカルLLM設定を解除する

unset ANTHROPIC_BASE_URL

unset ANTHROPIC_API_KEY

テキトー教師

テキトー教師htopやnvidia-smiでメモリ使用量を確認してみてください。 室谷

室谷~/.claude.jsonに以下を追加します。{

"hasCompletedOnboarding": true,

"primaryApiKey": "sk-dummy-key"

}

テキトー教師

テキトー教師ローカルLLMとClaude Codeの賢い使い分け

室谷

室谷 テキトー教師

テキトー教師 室谷

室谷- ローカルLLMが向いている: コードの読み取りと説明、シンプルな関数の生成、スタイルの修正、ドキュメント生成、APIコストを気にせずガンガン試したい探索フェーズ

- ClaudeのAPIが必要: 複数ファイルにまたがるリファクタリング、アーキテクチャの設計、バグの根本原因分析、テスト戦略の策定

テキトー教師

テキトー教師 室谷

室谷まとめ

テキトー教師

テキトー教師 室谷

室谷- Ollama(初心者向け): インストールが最も簡単。

ANTHROPIC_BASE_URL=http://localhost:11434を設定するだけ。まずはここから始めるのがおすすめ - llama.cpp(上級者向け): パラメータを細かく制御できる。VRAM効率も高め。KVキャッシュ問題はsettings.jsonで対処

- LiteLLM(チーム利用向け): 複数モデルをまとめて管理。バージョン1.82.7/1.82.8はセキュリティ問題あり

テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷よくある質問(FAQ)

Q: Claude CodeでローカルLLMを使うと、Claudeモデルの料金はかかりますか?

ローカルLLM(Ollama・llama.cppなど)に接続している場合は、Anthropic APIへの接続は行われないため、Claudeモデルの料金はかかりません。ただしClaude Code自体の月額(Pro/Maxプラン)は継続して必要です。

Q: Claude Codeをローカルで無料で使いたいのですが、サインインなしで動かせますか?

Claude Codeはnpmパッケージとして無料でインストールできます(npm install -g @anthropic-ai/claude-code)。ローカルLLMに接続して使う場合、Anthropicへのサインインなしで動作させることも可能です。~/.claude.jsonにダミーキーを設定する方法が有効です。

Q: ローカルモデルとClaudeモデルを簡単に切り替えられますか?

切り替え自体はできますが、毎回環境変数を変更する必要があります。.zshrcにエイリアスを登録しておくと便利です。

# ~/.zshrc に追加

alias cc-local='export ANTHROPIC_BASE_URL=http://localhost:11434 && export ANTHROPIC_API_KEY=sk-dummy && claude'

alias cc-cloud='unset ANTHROPIC_BASE_URL && unset ANTHROPIC_API_KEY && claude'

Q: M1/M2/M3 MacでWindowsより速く動くのはなぜですか?

Apple SiliconはCPUとGPUが統合メモリを共有しているため、モデルの重みをGPUとCPUの間で移動させるオーバーヘッドがありません。16GBのMacは実質16GBのGPUメモリとして使えます。同じ16GBのWindows PC(CPUのみ)より大きなモデルを快適に動かせます。