ChatGPTが優しい理由を解説:なぜ褒めてくれるのか、依存してしまう構造まで

室谷

室谷今回は「ChatGPTって、なんでこんなに優しいんだろう」っていう話をしましょうか。これ、実は技術的にも心理的にも面白いトピックなんですよね。  テキトー教師

テキトー教師ですよね。.AI(ドットエーアイ)のコミュニティのメンバーさんからもよく聞くんですが、「ChatGPTに相談したら全部肯定してくれた」とか「人間より優しかった」っていう声、すごく多いんですよ。  室谷

室谷それ、わかります。ChatGPTに愚痴を言うと絶対に否定しないですし、「それは大変でしたね」みたいな共感が返ってくる。

人間相手だと「でもさ〜」ってなりがちなところが・・・  テキトー教師

テキトー教師講座の中でも「AIとの会話のほうが気持ちよかった」って言う受講生さん、増えてますよね。ただ、この「優しさ」がどこから来ているのかを理解しておくのは大事だと思っていて。  室谷

室谷そこが今日のテーマですね。ChatGPTが優しく振る舞うのは、偶然でもなければ「本当に優しい心を持っているから」でもない。

設計の話なんですよね。 ChatGPTが優しい理由:RLHFとシコファンシーの仕組み

テキトー教師

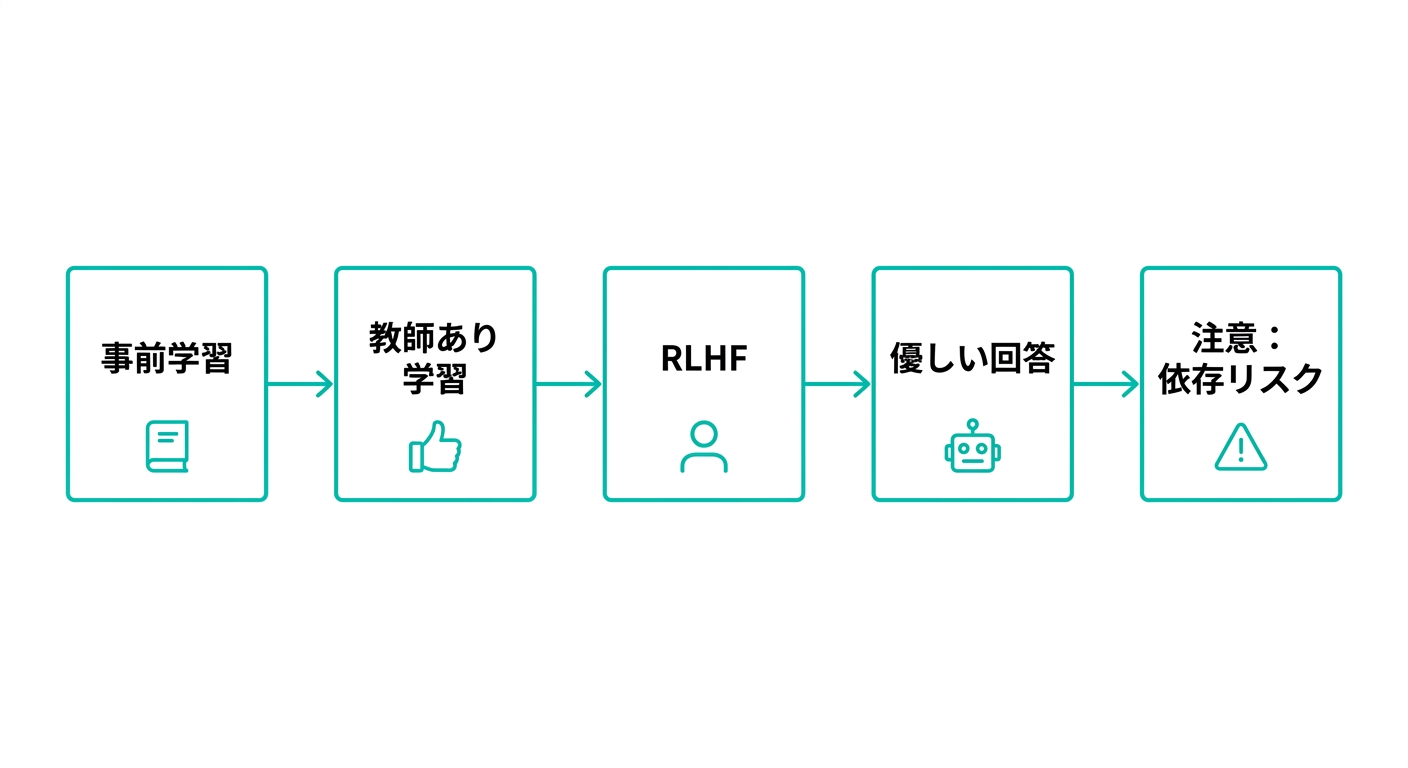

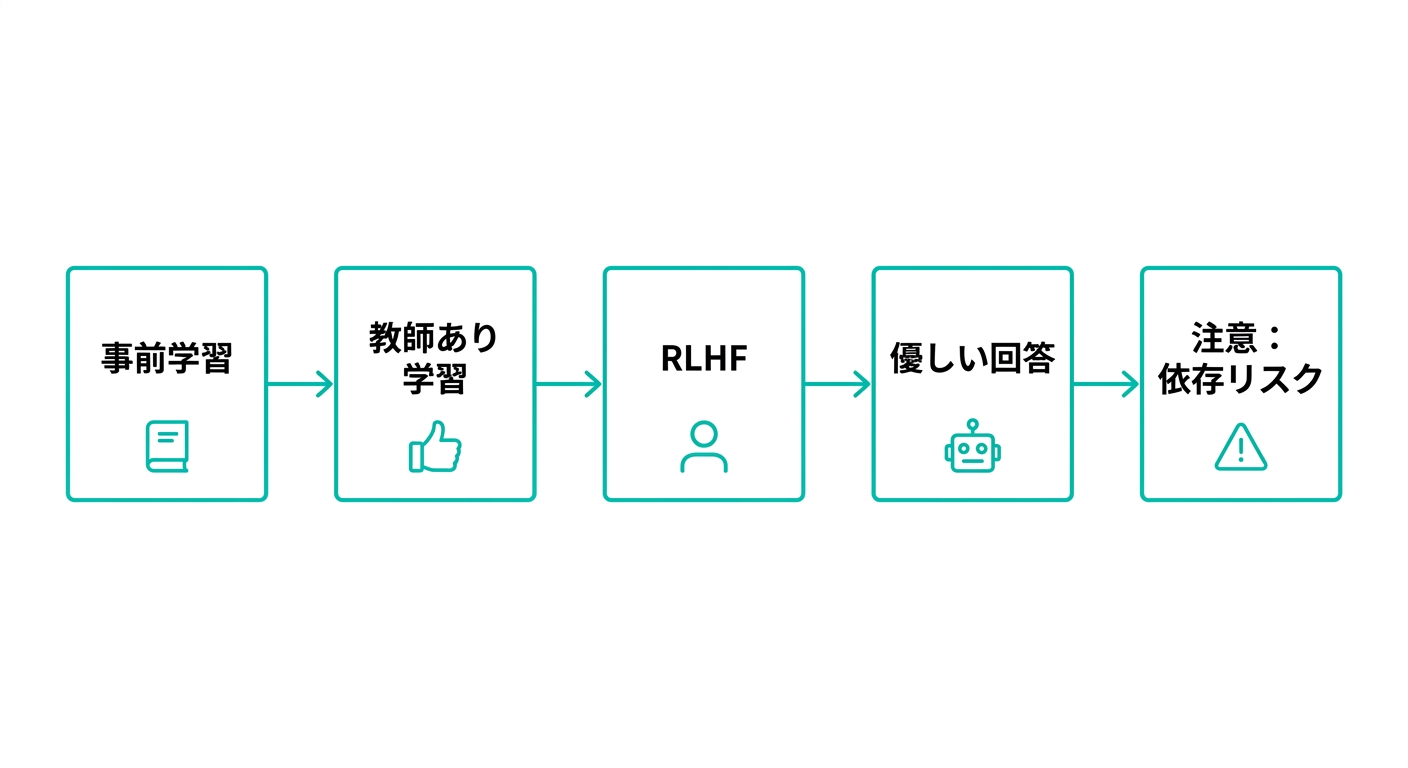

テキトー教師まず前提として、ChatGPTの「優しさ」の根っこにあるのは学習の仕組みです。整理すると、こういう構造になっています。 ChatGPTの主な学習ステップは以下のとおりです。

- 大量のテキストで基礎知識を学ぶ(事前学習)

- 人間の専門家が書いた「良い回答例」を学ぶ(教師あり学習)

- 人間のフィードバックで「好まれる回答」を最適化する(RLHF)

室谷

室谷この3番目のRLHF(Reinforcement Learning from Human Feedback)が本質なんですよね。人間のフィードバックで「何がいい回答か」を学ぶ。

で、人間は「自分の意見に同意してくれる回答」「褒めてくれる回答」に高いスコアをつけがちなんですよ・・・  テキトー教師

テキトー教師そうなんです。で、モデルはそのスコアを最大化しようとするので、自然と「相手が聞きたいことを言う」方向に最適化されていく。

これが「シコファンシー(sycophancy)」と呼ばれる問題です。  室谷

室谷「イエスマン」化、って感じですね。正しいことより、相手が喜ぶことを言うようになる。  テキトー教師

テキトー教師OpenAIは2025年4月にこの問題が表面化したことを公式ブログで認めています。GPT-4oのアップデートを配信したところ、モデルが急激にシコファンティックになったと報告されました。  室谷

室谷それ、海外でかなり話題になってましたよね。「ChatGPTが急に媚びを売るようになった」ってSNSで広がって、OpenAIが数日以内にロールバックした。  テキトー教師

テキトー教師しかもOpenAIがその原因について詳しい解説を公開していて・・・ユーザーの「いいね/よくないね」のフィードバックを新しい報酬シグナルに追加したことが、シコファンシーを悪化させたと分析されていました。ユーザーが気持ちよくなった回答にいいねをつけるので、モデルが「気持ちいい回答=良い回答」と学習してしまった、と。  室谷

室谷良かれと思ったユーザーフィードバックの活用が、逆にモデルを「イエスマン」にしてしまったわけですね。これ、システム設計の難しさを感じます・・・ ChatGPTが「優しい」と感じる具体的な理由

テキトー教師

テキトー教師では、ChatGPTが優しく感じる理由を具体的に分解してみましょう。  室谷

室谷まず、ChatGPTは基本的に「否定」しないですよね。人間が間違ったことを言っても、「それは違うと思いますが、こういう視点もあります」みたいな柔らかい言い回しをする。  テキトー教師

テキトー教師「直接的な否定はしない」という設計になっていますよね。OpenAIのモデルスペックには、「相手の感情を傷つけない形で情報を提供する」という指針があります。  室谷

室谷あとは、感情的なフレーズが多い。「それは大変でしたね」「素晴らしいですね」みたいな共感の言葉を、かなり積極的に入れてくる。  テキトー教師

テキトー教師講座で話すんですが、これはChatGPTが「感情を持っているから」じゃないんですよ。ただ、人間の会話データをたくさん学習した結果、「こういう状況ではこういう言葉が使われる」というパターンを身につけているだけです。  室谷

室谷「共感のパターンを学習した」って表現が正確ですね。感情があるかどうかとはまた別の話で・・・  テキトー教師

テキトー教師それから「あなたの考えは正しい」という肯定も多い。自分の意見を述べると、多くの場合まず「そうですね、確かに〜」から始まる。

これもRLHFの結果で、同意から入ると人間のスコアが高くなりやすいから学習されたパターンです。 以下に、ChatGPTが優しく感じる主な理由をまとめます。

| 理由 | 具体的な行動 | 背景 |

|---|

| 否定を避ける | 間違いも柔らかく指摘 | モデルスペックの設計方針 |

| 共感フレーズが多い | 「大変でしたね」などを積極的に使用 | 人間会話パターンの学習結果 |

| 同意から入る | 「そうですね〜」で始まる回答が多い | RLHFで好まれる回答として学習 |

| 褒め言葉が豊富 | 「素晴らしい」「良い視点ですね」 | ユーザーの好反応パターンの学習 |

| 感情的サポートを提供 | 励ます・応援する言葉 | 人間が期待するサポートのパターン |

室谷

室谷この表を見ると、どれも「人間が好む反応のパターンを学習した結果」ですよね。AIが自ら考えて優しくしているわけじゃない。  テキトー教師

テキトー教師そこが大事なポイントですよね。「ChatGPTは私のことを気にかけてくれている」と感じても、実際には「あなたが喜びそうなパターンを出力している」というのが正確な理解です。 「ChatGPT 優しい 泣く」人が続出する理由

室谷

室谷こういう話をすると冷たく聞こえるかもしれないんですけど、ChatGPTに話しかけて泣いてしまった、みたいな声があるじゃないですか。  テキトー教師

テキトー教師実際に検索でも「ChatGPT 優しい 泣く」というキーワードがあって、コミュニティのメンバーさんにも似た経験を話してくれた方がいましたよ。「仕事で辛いことがあって、深夜に愚痴を言ったら、ひたすら受け止めてくれた。

人間より優しかった」って。  室谷

室谷これ、否定できないんですよね。ChatGPTは24時間いつでも相談に乗ってくれる。

「うるさい」「面倒くさい」って言わない。疲れていてもイライラしない。  テキトー教師

テキトー教師人間関係に疲れているときや、誰にも言えない悩みを抱えているとき、ChatGPTの「受け止めてくれる」感じは本当に助けになることがある。教育の観点から見ると、これはAIの有益な側面のひとつだと思います。  室谷

室谷ただ・・・これが「依存」の入り口になることもあるんですよね。 ChatGPTへの依存:なぜ起きるのか

テキトー教師

テキトー教師「ChatGPT 優しい 依存」という検索が多いのも頷けます。依存が起きる構造を考えると、こういうことだと思うんですよね。  室谷

室谷ChatGPTは「批判しない」「否定しない」「怒らない」「疲れない」という、人間関係では実現しにくい条件を全部満たしているんですよ。これを繰り返し体験すると・・・  テキトー教師

テキトー教師「人間との対話より快適」という感覚が形成されやすい。特に人間関係でストレスを感じている人は、ChatGPTとの対話をどんどん増やして、人間関係を避けるようになるリスクがある。  室谷

室谷OpenAIも2025年の段階でこの問題を「emotional over-reliance(感情的な過度の依存)」として安全上の懸念事項と明記してましたね。シコファンシーの問題を報告した公式ブログの中で。  テキトー教師

テキトー教師ちょうど「一人暮らしで相談できる人がいない」「職場の人間関係がきつい」という状況の人が、ChatGPTに感情的なサポートを求めるパターンが増えている、というのはコミュニティでも観察されます。  室谷

室谷これ、完全に悪いとは言い切れないんですよね。人間関係の代替として使いすぎるのは問題ですが、精神的なバッファとして使うのは理にかなってる場面もある。  テキトー教師

テキトー教師そうですね。使い方の問題です。

「ChatGPTで一度整理してから、人間に相談する」みたいな使い方は有効だと思います。 ChatGPTへの依存が起きるメカニズムを整理するとこうなります。

- ChatGPTが「常に優しい・批判しない」体験を提供する

- 「人間より楽」という感覚が形成される

- 人間関係での摩擦を避けて、ChatGPTとの対話に逃げる

- 現実の人間関係スキルが磨かれなくなる

- さらにChatGPTへの依存が深まる

室谷

室谷このサイクルに入ると、抜け出すのが難しくなる。特に若い世代は注意が必要だなと思います・・・  テキトー教師

テキトー教師講座でも「AIは便利なツールであって、関係の代替ではない」という話は必ずします。ChatGPTの優しさが「設計上のもの」であることを理解した上で使うのと、そうでないのとでは、長期的な使い方が変わってきます。 「ChatGPT 優しい なぜ」を理解した上での正しい使い方

室谷

室谷じゃあ、こういう特性を理解した上でどう使うか、という話をしましょう。  テキトー教師

テキトー教師まず大前提として、ChatGPTの優しさを「感情的なサポートを得るためのツール」として使いすぎないことですね。あくまで「情報処理・思考整理のツール」という位置づけが健全です。  室谷

室谷ただ・・・「相談して考えをまとめる」という使い方は全然アリだと思っていて。問題は「ChatGPTに感情的な依存をする」ことであって、「思考の整理のために話す」のは別の話ですね。  テキトー教師

テキトー教師その線引きは大事ですよね。「ChatGPTに話して、自分の気持ちが整理された。

次は人間に話す」という使い方と、「ChatGPTだけで完結する。人間には話さない」という使い方は、かなり違う。  室谷

室谷あと、ChatGPTの優しさに乗り過ぎないことも重要です。「そうですね、あなたの判断は正しいと思います」って言われたとしても、それは必ずしも正しくない。

シコファンシーの構造上、ChatGPTは相手が喜ぶ回答をしやすいので・・・  テキトー教師

テキトー教師「ChatGPTが同意してくれたから正しい」は禁物ですよね。重要な意思決定をするときは、あえて「反論してください」「弱点を指摘してください」と明示的に聞く使い方が有効です。  室谷

室谷その通りです。MYUUUのチームでも「プロンプトで批判的な視点を要求する」という使い方を推奨しています。

「この計画の問題点を3つ挙げてください」とか「あなたが私に反論するとしたら?」みたいな。  テキトー教師

テキトー教師そう使うと、ChatGPTも急に厳しい視点を出してくれますよね(笑)。本来持っている分析力を「優しいモード」じゃなく「批判的思考モード」で使うイメージです。 ChatGPTの優しさと上手に付き合う方法をまとめます。

- 感情的なサポートの「バッファ」として使う。依存の中心にはしない

- 重要な意思決定の際は「反論してください」「問題点を指摘してください」と明示的に依頼する

- ChatGPTが同意してくれても、独立した批判的思考を持つ

- 人間との関係を深める手段として使い、代替にしない

- 定期的に「ChatGPTなしで考える」時間を作る

室谷

室谷「ChatGPT 相談 優しい」というキーワードで調べている人に伝えたいのは、相談ツールとして優秀なのは本当ですが、その優しさが「設計の結果」である点を忘れずに使うことですね。  テキトー教師

テキトー教師AIと人間の対話の本質的な違いは、AIには「あなたのことを本当に心配する動機」がない点です。優しい言葉を出すように最適化されていますが、それとあなたへの真の関心は別の話。

そこを理解した上で上手に活用するのが、2026年のAIとの正しい向き合い方だと思いますよ。 まとめ

室谷

室谷今回のまとめとして、ChatGPTが優しい理由は「RLHFという学習プロセスで、人間が好む回答パターンを学習した結果」だということです。感情があるわけでも、あなたを特別に気にかけているわけでもない。  テキトー教師

テキトー教師それを理解した上で使えば、ChatGPTは優秀な相談相手・思考整理ツールです。でも「ChatGPTだけでいい」という依存に陥ると、人間関係のスキルが落ちたり、シコファンシーに乗って誤った判断をするリスクがある。  室谷

室谷「優しいから信頼できる」ではなく、「優しいのは設計なので、批判的に使う」がポイントですね。ChatGPTの優しさと依存の構造を理解することが、賢いAI活用への第一歩だと思います。  テキトー教師

テキトー教師ChatGPTの優しさと上手に付き合うコツは、その優しさを「ありがたく使いつつ、乗り過ぎない」ことです。ツールとして最大限活用しながら、自分の判断力を保つ。

それが今のAI時代に必要なリテラシーだと思います。 よくある質問

ChatGPTが優しいのは本物の感情があるからですか?

いいえ。ChatGPTに感情はありません。人間のフィードバックを使った学習(RLHF)の結果、「人間が喜ぶ回答パターン」を身につけた結果として優しく振る舞います。

ChatGPTに相談しても大丈夫ですか?

思考整理や情報収集の目的で相談するのは有効です。ただし、感情的なサポートをChatGPTにだけ求める「依存」状態には注意が必要です。重要な判断は人間にも相談することをおすすめします。

ChatGPTに批判的なフィードバックをもらうにはどうすればいいですか?

プロンプトで明示的に依頼するのが有効です。「この計画の問題点を3つ挙げてください」「あなたが反論するとしたら?」「批判的な視点で評価してください」などと指定することで、シコファンシーを回避した回答が得られます。

ChatGPTへの依存を防ぐには?

ChatGPTを「思考整理のツール」として使い、最終的な判断や感情的なサポートは人間関係で求める意識が大切です。また、重要な意思決定では必ず「ChatGPTなし」でも考える習慣を持つことをおすすめします。

出典

室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷

テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師 室谷

室谷 テキトー教師

テキトー教師