ChatGPTとLLMの関係、どう説明する?

室谷

室谷今回はChatGPTとLLMの話をしましょう。「ChatGPTってLLMなの?」「LLMとChatGPTって同じもの?」って聞かれること、.AI(ドットエーアイ)のコミュニティでも結構あるんですよね。

テキトー教師

テキトー教師講座でも必ず出てくる質問ですね。特にAIを使い始めたばかりの方が混乱しやすいポイントで、整理すると理解がぐっと深まる部分です。

今日はここを徹底的に解説しましょう。

今日はここを徹底的に解説しましょう。

室谷

室谷ざっくり言うと、LLMは「技術・エンジン」で、ChatGPTは「それを使ったサービス・製品」なんですよね。でも本当に面白いのは、ChatGPTが普及したことでLLMという言葉自体が一般に広まった、という逆転現象があるところで・・・

テキトー教師

テキトー教師教える立場から言うと、「ChatGPTを知ってからLLMを学ぶ」人がほとんどなので、順番が逆になっています。だからこそ「LLMとは?」の説明が難しくなるんですよ。

LLMとは?大規模言語モデルの仕組みをわかりやすく解説

テキトー教師

テキトー教師まずLLMの基本から整理しましょう。LLMはLarge Language Modelの略で、日本語で「大規模言語モデル」のことです。

室谷

室谷「大規模」「言語」「モデル」という3つの言葉がそれぞれポイントになっていて・・・

テキトー教師

テキトー教師そうですね。それぞれこういう意味です。

- 大規模(Large): 膨大なテキストデータを学習している。インターネット上の文章、書籍、論文など数百億〜数兆トークン規模

- 言語(Language): 文章を扱うことに特化している。テキストの入力を受け取り、テキストを出力する

- モデル(Model): 機械学習で構築された数学的なシステム。パラメータと呼ばれる重みが膨大な数ある

室谷

室谷パラメータ数で「どれだけ大規模か」がわかるんですよね。GPT-3は1,750億パラメータで公開時にかなり話題になりましたけど、最新世代のモデルはそれを大きく超えています。

テキトー教師

テキトー教師コミュニティのメンバーさんがよく驚くのがここで、「1,750億ってどのくらいの規模?」ってなるんですよ。人間の脳のシナプス数が約100兆なので、数字だけ見るとまだ差があります。

それでも文章を書けるし翻訳できるし、コードも書けてしまう。

それでも文章を書けるし翻訳できるし、コードも書けてしまう。

室谷

室谷LLMの核心にあるのはTransformerというアーキテクチャで、2017年にGoogleが発表した論文「Attention is All You Need」が起源なんですよね。これがなかったらChatGPTも存在しなかった・・・

テキトー教師

テキトー教師「注意機構(Attention Mechanism)」というのがポイントで、文章中のどの単語に着目するかをモデルが学習できるようになりました。「私はリンゴを食べた。

それは美味しかった」という文章で、「それ」が「リンゴ」を指すことを理解できる仕組みです。

それは美味しかった」という文章で、「それ」が「リンゴ」を指すことを理解できる仕組みです。

室谷

室谷難しく聞こえますが、本質は「文脈を理解して次の単語を予測する」ということで、それを繰り返すことで文章が生成される、というシンプルな話なんですよ。

テキトー教師

テキトー教師そう、核心はシンプルです。「次にどんな言葉が来るか」を膨大なテキストから学習したのがLLM。

それだけで翻訳も要約も質問応答もできてしまう。

それだけで翻訳も要約も質問応答もできてしまう。

ChatGPTとLLMの関係と違いを整理する

室谷

室谷では本題のChatGPTとLLMの関係です。一言で言うと、ChatGPTはLLMを使って作られたサービスです。

テキトー教師

テキトー教師車のエンジンとクルマの関係に近いですね。エンジン(LLM)が動力源で、クルマ(ChatGPT)はそれを乗り物として使えるようにしたもの。

室谷

室谷その例えはわかりやすいですね。OpenAIはGPTシリーズというLLMを開発していて、ChatGPTはそのGPTモデルを会話インターフェースとして使えるようにしたサービスです。

テキトー教師

テキトー教師整理するとこういう関係です。

- LLM: AIの「頭脳」に相当する技術そのもの。テキストを入力するとテキストを出力する

- ChatGPT: OpenAIが作ったWebサービス・アプリ。LLMをチャット形式で使えるようにした製品

- GPT-5.4: ChatGPTが現在使っているLLMのモデル名(OpenAI公式より)

室谷

室谷だから「LLMを使う=ChatGPTを使う」ではないんですよね。LLMは他にもたくさんあるし、ChatGPTを使わずにOpenAIのLLMをAPIで直接呼び出すこともできる。

テキトー教師

テキトー教師ここが混乱しやすいポイントで、ChatGPTのブランド力が強すぎて「生成AI=ChatGPT」みたいなイメージになっている方が多いんですよ。でも実際は、Claude(AnthropicのLLM)、Gemini(GoogleのLLM)、LlamaやMistral(オープンソースLLM)と、LLMは多種多様にあります。

室谷

室谷MYUUUでいろんな企業のAI活用を見ていても、「ChatGPTしか知らなかった」から「用途によってLLMを使い分ける」への変化が最近の流れですね。

テキトー教師

テキトー教師違いを表にまとめると、こうなります。

| 項目 | LLM | ChatGPT |

|---|---|---|

| 種類 | 技術・モデル | サービス・製品 |

| 提供形態 | APIや組み込みで提供 | Webアプリ・スマホアプリ |

| 開発元 | OpenAI、Google、Meta等 | OpenAI |

| 例 | GPT-5.4、Claude、Gemini、Llama | chatgpt.com、iOSアプリ |

| 使い方 | コードからAPI呼び出し | ブラウザ・アプリから対話 |

室谷

室谷この表を見ると一目瞭然ですね。ChatGPTはLLMを「使う入口」であって、LLMそのものではない。

テキトー教師

テキトー教師さらに言うと、LLMとNLPや生成AIとの違いも混乱しやすいポイントなので、次はそこを解説しましょう。

LLMとNLP・生成AIの違い:ChatGPTはどれに当たる?

室谷

室谷「ChatGPTはLLMなのか、NLPなのか、生成AIなのか」という質問も多いんですよね。実はこれ、全部正解なんですよ。

テキトー教師

テキトー教師これ、教える立場からするとなかなか難しいんですよ(笑)。それぞれが違う切り口の分類なので。

室谷

室谷整理するとこういう関係になります。

- NLP(自然言語処理): 人間の言語をコンピュータで扱う技術全般の総称。LLMはNLPの技術の一種

- LLM: 大規模な言語モデル。NLPの手法の中でも特に大規模なもの

- 生成AI(Generative AI): テキスト・画像・音声・動画などを「生成」するAI全般

- ChatGPT: LLMをベースにした生成AIサービス

テキトー教師

テキトー教師つまりChatGPTは「NLPの技術(具体的にはLLM)を使った生成AIサービス」というのが正確な説明です。

室谷

室谷「is ChatGPT LLM or NLP」という海外での検索が多いのもそのせいで、どちらでもあるし、どちらでもないとも言えてしまう・・・

テキトー教師

テキトー教師LLMが登場する前のNLPと比べると、すごく大きな違いがあります。昔のNLPは「感情分析」や「単語の品詞判定」みたいなシンプルなタスクが主流でした。

LLMが登場してから、同じNLPの技術でも「文章を書く」「会話する」「コードを生成する」という複雑なことができるようになった。

LLMが登場してから、同じNLPの技術でも「文章を書く」「会話する」「コードを生成する」という複雑なことができるようになった。

室谷

室谷LLMが登場してNLPそのものが変わったとも言えますよね。昔の「NLPはこういうもの」という常識が崩れた。

テキトー教師

テキトー教師「生成AI」との関係で言うと、生成AIの中にはテキスト生成だけでなく画像生成(Stable Diffusionなど)や動画生成もあります。LLMはその中でも「テキストに特化した生成AI」と言えます。

室谷

室谷ChatGPT Image(GPT Image 1.5)は画像も生成できるようになっているので、今やChatGPTはLLMだけじゃなくマルチモーダルなモデルを使っているんですよね。

ChatGPTが使っているLLMモデルの変遷

テキトー教師

テキトー教師次はChatGPTが実際にどのLLMを使っているかを整理しましょう。ここを知ると「ChatGPTとLLMの関係」がより具体的に見えてきます。

室谷

室谷OpenAI公式のを見ると、現在のフロンティアモデルはGPT-5.4系列ですね。

テキトー教師

テキトー教師2026年時点でのChatGPTのメインモデルはこうなっています。

| モデル | 特徴 | コンテキストウィンドウ |

|---|---|---|

| GPT-5.4 | 複雑な推論・コーディングに最適 | 1M tokens |

| GPT-5.4 mini | 低コスト・高速、サブエージェント向け | 400K tokens |

| GPT-5.4 nano | 最安コスト、大量処理向け | 400K tokens |

室谷

室谷GPT-5.4のコンテキストウィンドウが1Mトークンというのはすごいですよね。ちょっと前まで「128Kすごい!」ってなってたのに・・・

テキトー教師

テキトー教師1Mトークンって日本語だと約150万文字くらいのイメージです。本を何冊も丸ごと読み込めるレベルですね。

室谷

室谷ChatGPTの歴史的な流れを見ると、LLMの進化がそのままChatGPTの進化になってきたわけです。

ChatGPTのLLMモデルの歴史

テキトー教師

テキトー教師振り返ると、ChatGPTとLLMの歴史はこんな流れです。

- 2022年11月: ChatGPT公開(GPT-3.5ベース)。「InstructGPT」と呼ばれる手法でチューニング

- 2023年3月: GPT-4搭載のChatGPT Plus開始。マルチモーダル対応が始まった

- 2024年: GPT-4o(オムニ)登場。テキスト・音声・画像を統合したモデルへ

- 2025年: GPT-5登場。推論能力が大幅向上

- 2026年: GPT-5.4系列が現在のメインモデル。1Mトークンコンテキスト

室谷

室谷この流れを見ると、LLMの進化スピードが本当に速いんですよね。2022年に「すごい!」と思ったGPT-3.5が今や旧世代になってる。

テキトー教師

テキトー教師講座で「最新情報をキャッチアップするのが大変」という声が多いのも、このスピード感が原因ですよね。ただ基本的な仕組み(Transformerベース、テキスト予測)は変わっていないので、根本を理解しておくと変化に追いつきやすいです。

ChatGPT以外のLLM:ローカルLLMとオープンソースの選択肢

室谷

室谷ChatGPTを使わずにLLMを使う選択肢の話をしましょう。これ、企業のAI活用で最近すごく重要になってるんですよね。

テキトー教師

テキトー教師「ローカルLLM」「オープンソースLLM」という選択肢ですね。コミュニティのメンバーさんからも「ChatGPTだとデータを外部に送りたくない」という相談が増えています。

室谷

室谷代表的な選択肢をまとめると、こうなります。

クラウドLLM(ChatGPT以外)

テキトー教師

テキトー教師まずクラウドで提供されているLLMのChatGPT以外の選択肢です。

| サービス | LLMモデル | 開発元 | 特徴 |

|---|---|---|---|

| Claude | Claude(最新はClaude Opus 4.6等) | Anthropic | 安全性重視、長文対応に強み |

| Gemini | Gemini(最新はGemini 3 Pro等) | 検索との連携、マルチモーダル | |

| Copilot | GPT-5.4ベース | Microsoft | Officeとの統合 |

| Grok | Grok(最新はGrok 4等) | xAI | リアルタイム情報に強み |

室谷

室谷面白いのはCopilotで、中身はOpenAIのGPTを使っているんですよね。つまりLLMは同じでも、サービスが違えば使い方もUIも全然違う。

テキトー教師

テキトー教師これがまさに「LLMとサービスは別物」の典型例ですよね。

ローカルLLM・オープンソースLLM

室谷

室谷次はローカルLLMの話です。「local llm vs chatgpt」という比較で検索する方が増えているのは、データプライバシーへの関心が高まっているからだと思いますね。

テキトー教師

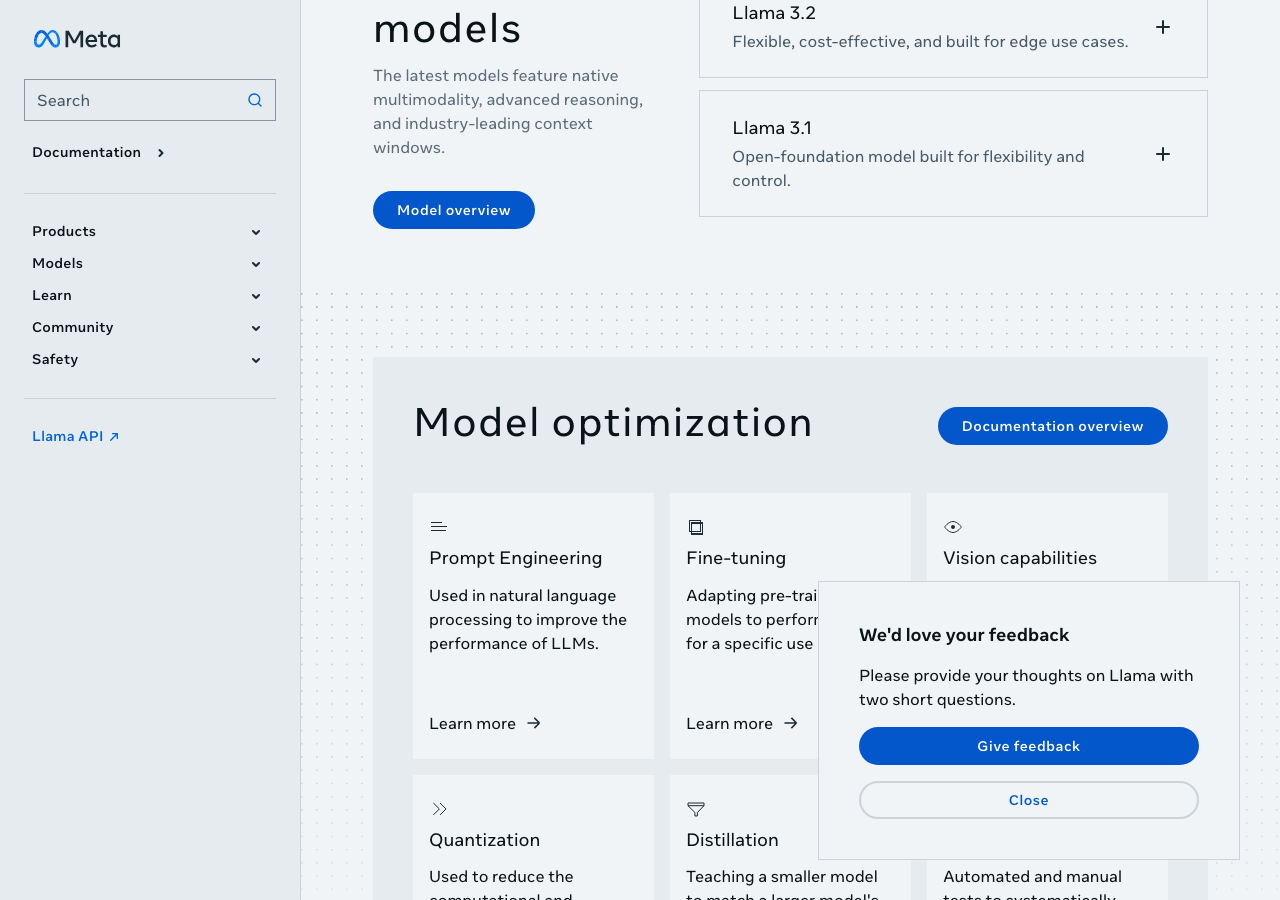

テキトー教師自分のPC上でLLMを動かすことで、データが外部に送られないという安心感があります。代表的なものはMetaのLlamaシリーズです。

室谷

室谷によると、最新のLlama 4(Maverick、Scout)はネイティブのマルチモーダル対応で10Mトークンのコンテキストウィンドウを持っています。オープンソースなのにここまでの性能が出てきたのはすごいですよね・・・

テキトー教師

テキトー教師ローカルLLMのメリット・デメリットを整理すると、こうなります。

| 観点 | ローカルLLMのポイント |

|---|---|

| データプライバシー | 外部に送信されない |

| コスト | 従量課金なし(ハードウェア投資は必要) |

| カスタマイズ | ファインチューニングが可能 |

| 性能 | 最新クラウドLLMより劣る場合が多い |

| 運用 | オフラインでも動作、モデル更新は自己管理 |

室谷

室谷MYUUUでも最近、機密性の高いデータを扱うプロジェクトではローカルLLMを検討するケースが出てきています。「全部ChatGPTに送ればいい」という時代は終わりつつある。

テキトー教師

テキトー教師ローカルで動かすツールとして定番なのはOllamaで、コマンド一発でLlamaやMistralを動かせます。

# Llama 4を動かす例(デフォルト)

ollama run llama4

# Llama 4 Scout(軽量版)を動かす例

ollama run llama4:scout

室谷

室谷ただし「chatgpt vs local llm」で比較すると、現時点ではトップのクラウドLLMの方が性能は高いんですよね。ローカルLLMはセキュリティ・コスト優先の用途に向いています。

ChatGPTのLLMをAPIで使う方法

テキトー教師

テキトー教師次はAPIの話をしましょう。「chatgpt llm api」という検索も多いですよね。

ChatGPTのブラウザを使わず、プログラムから直接OpenAIのLLMを呼び出す方法です。

ChatGPTのブラウザを使わず、プログラムから直接OpenAIのLLMを呼び出す方法です。

室谷

室谷これができるようになると、自分のアプリやサービスにLLMを組み込めるんですよね。DifyもOpenAIのAPIを使えるし、Claude CodeもAnthropicのAPIを使っている。

テキトー教師

テキトー教師OpenAI APIの基本的な呼び出し方はこうです。に詳しい手順があります。

from openai import OpenAI

client = OpenAI()

response = client.responses.create(

model="gpt-5.4",

input="ChatGPTとLLMの違いを教えてください"

)

print(response.output_text)

室谷

室谷このコードで「chatgpt llm」のLLMに直接アクセスできるんですよね。ChatGPTというUIを通さず、モデルそのものを呼び出している。

テキトー教師

テキトー教師コミュニティのメンバーさんが「DifyでOpenAI APIを設定しました」と言うときも、裏でやっているのはこれと同じことです。LLMモデル(GPT-5.4等)のAPIエンドポイントにリクエストを送っている。

室谷

室谷APIの料金体系も理解しておくといいですよね。ChatGPT(月額プラン)とAPIは別の課金体系で・・・

テキトー教師

テキトー教師そうですね。ChatGPTはサブスクリプション(月額定額)で、APIは従量課金(トークン数に応じた課金)です。

頻繁に大量にLLMを呼び出すシステムを作るなら、APIの方が管理しやすいです。

頻繁に大量にLLMを呼び出すシステムを作るなら、APIの方が管理しやすいです。

APIの料金の目安

室谷

室谷2026年4月時点のOpenAI APIの料金はこうなっています(より)。

| モデル | 入力(1Mトークン) | 出力(1Mトークン) |

|---|---|---|

| GPT-5.4 | $2.50 | $15.00 |

| GPT-5.4 mini | $0.75 | $4.50 |

| GPT-5.4 nano | $0.20 | $1.25 |

テキトー教師

テキトー教師1Mトークンが日本語で約150万文字くらいのイメージなので、普通に使う分にはかなり安い感覚です。ただ大量のバッチ処理をすると積み重なるので注意が必要ですね。

室谷

室谷ChatGPT Plusが月$20で使い放題なのに対して、APIは使った分だけ払う。どちらがお得かは使い方次第ですね。

LLMの仕組みをもう少し深掘り:学習とファインチューニング

テキトー教師

テキトー教師LLMの仕組みをもう少し深掘りしましょう。ChatGPTがなぜ「賢く」なったのか、という話です。

室谷

室谷LLMの学習には大きく2段階あって、「事前学習(Pre-training)」と「ファインチューニング」なんですよね。

テキトー教師

テキトー教師整理するとこういう流れです。

事前学習(Pre-training)

テキトー教師

テキトー教師第1段階は「事前学習」。インターネット上の膨大なテキストを使って、「次の単語を予測する」というシンプルなタスクを無数に繰り返します。

この段階でモデルは言語の基本的なパターンを学習する。

この段階でモデルは言語の基本的なパターンを学習する。

室谷

室谷この段階のモデルはいわば「Webの知識をそのまま圧縮したもの」で、質問に答えるという行動は学習していない状態なんですよね。

RLHF(人間のフィードバックによる強化学習)

テキトー教師

テキトー教師第2段階がOpenAIの「InstructGPT」から始まった手法で、RLHF(Reinforcement Learning from Human Feedback)です。人間のフィードバックを使って、「有用で安全な応答をするように」モデルを調整する。

室谷

室谷ChatGPTが単なる「テキスト補完ツール」ではなく「会話できるAI」になったのはこのRLHFのおかげなんですよね。

テキトー教師

テキトー教師ここが本質的な部分で、「LLMがあれば会話AIができる」わけではなく、会話に適したファインチューニングが必要です。

室谷

室谷だから同じGPT-5.4というベースモデルでも、APIで直接叩いたときと、ChatGPTのUIを通して使ったときで、微妙に応答のトーンが違うことがあるんですよ。

ChatGPTとLLMを使い分けるシーン

室谷

室谷実務的な観点で、ChatGPTとLLM APIをどう使い分けるかを話しましょう。これ、MYUUUでもよく議論になるんですよね。

テキトー教師

テキトー教師私のコミュニティのメンバーさんにも「いつAPIを使えばいいの?」という質問が多いですね。

室谷

室谷シンプルに分けるとこうです。

- ChatGPTを使う場面: 個人の日常業務(資料作成、リサーチ、翻訳)、すぐ使いたい、UIが欲しい

- LLM APIを使う場面: アプリ・サービスへの組み込み、大量バッチ処理、独自カスタマイズが必要

テキトー教師

テキトー教師もう一つ追加すると、「複数のLLMを比較したい」「特定のLLMに縛られたくない」という場合もAPIが向いていますね。DifyやLangChainのようなツールを使うと、バックエンドのLLMを簡単に切り替えられます。

室谷

室谷これが「LLMのコモディティ化」という現象で、今は「どのLLMを使うか」よりも「LLMをどうアプリに組み込むか」の方が重要になってきているんですよね。

テキトー教師

テキトー教師Difyはまさにそのためのノーコードツールで、バックエンドをOpenAIにするかAnthropicにするかを選択できる。LLMは部品として扱う発想です。

ChatGPTとLLMに関するよくある質問

室谷

室谷最後によくある質問にまとめて答えていきましょう。

テキトー教師

テキトー教師講座でも繰り返し出てくる質問が多いので、ここで整理しておきましょう。

ChatGPTはどのLLMを使っているの?

室谷

室谷2026年4月時点では、ChatGPTのメインモデルはGPT-5.4系列です。プランによって使えるモデルが異なります。

テキトー教師

テキトー教師ChatGPT Plusでは高性能なモデルが使えて、無料版ではその時点で公開されているモデルが使えます。が常に最新情報なので、モデルの詳細はそちらを確認するのがいいですね。

LLMとAIの違いは?

室谷

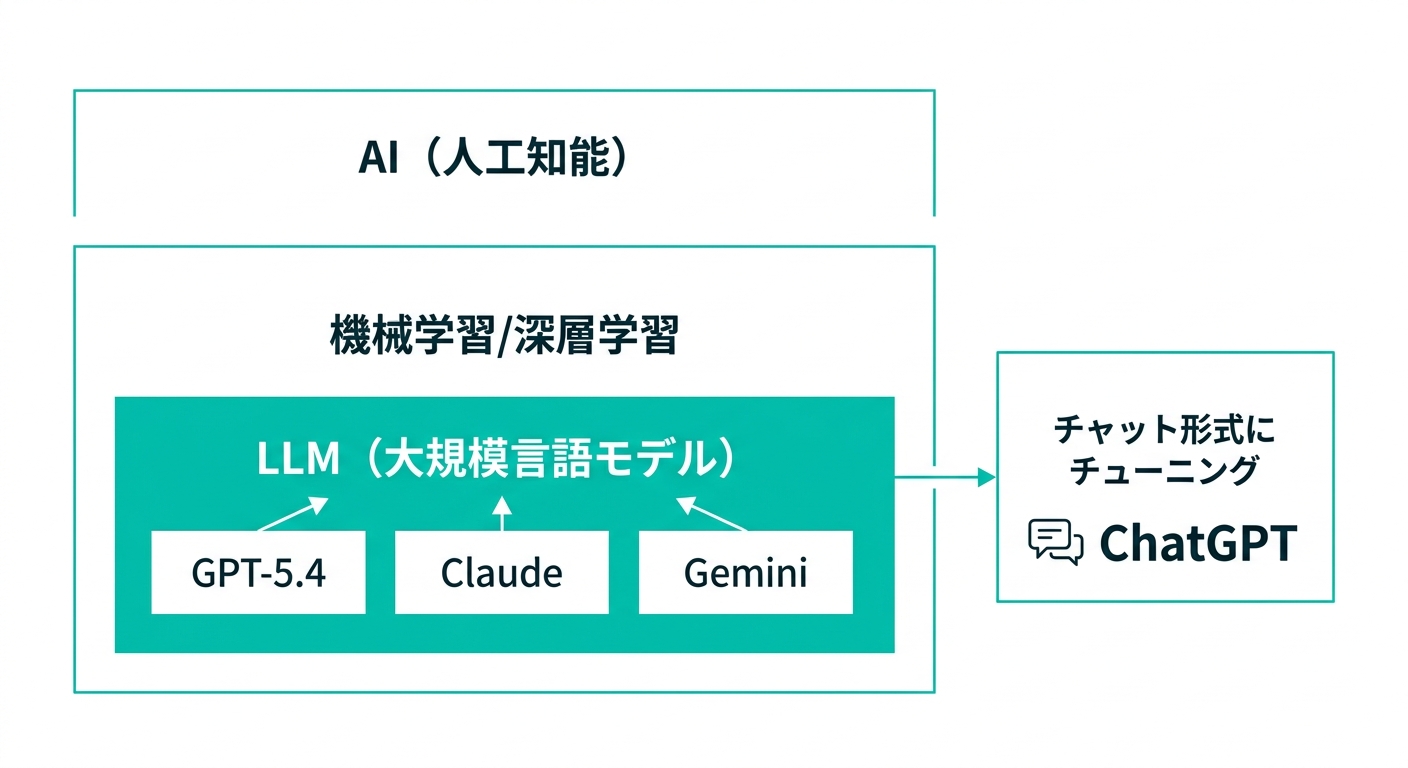

室谷LLMはAI(人工知能)の一部、という関係です。AIには画像認識、音声認識、強化学習など様々な技術がありますが、LLMはその中でも「言語を扱う」ことに特化した技術です。

テキトー教師

テキトー教師AI > 機械学習 > 深層学習 > LLM、という包含関係になっています。ChatGPTはLLMを使ったAIサービスです。

ChatGPTなしでLLMを使えるの?

室谷

室谷もちろんできます。OpenAIのAPIを使えばChatGPTのUIなしでGPT-5.4を使えますし、LocalのOllamaでLlamaを動かせばChatGPTとは完全に独立して使えます。

テキトー教師

テキトー教師「chatgpt llm download」という検索もありますが、ChatGPTのLLM(GPT-5.4等)はオープンソースではないのでダウンロードはできません。ダウンロードして使えるLLMが欲しい場合はMetaのLlamaやMistralが選択肢になります。

LLMとGenerative AIは同じ?

テキトー教師

テキトー教師違います。Generative AI(生成AI)はテキスト・画像・音声・動画など何でも生成するAI全般の総称で、LLMはその中の「テキスト生成に特化したもの」です。

室谷

室谷ただ最近のLLMはテキストだけじゃなく画像も扱えるようになっていて(GPT-5.4はビジョン対応)、境界線が曖昧になってきています。

まとめ:ChatGPTとLLMの関係を整理する

テキトー教師

テキトー教師今回の話を整理しましょう。

室谷

室谷キーポイントをまとめると、こうなります。

- LLMは技術、ChatGPTはサービス。エンジンとクルマの関係

- ChatGPTが使っているLLMはGPT-5.4系列(2026年4月時点)

- LLMはNLPの一技術、生成AIの一種。複数の概念が重なり合っている

- ChatGPT以外のLLMも多数存在。Claude、Gemini、Llama等

- APIを使えばChatGPTなしでLLMを直接使える。アプリ開発はAPIが基本

- ローカルLLMはプライバシー・コスト重視の選択肢。OllamaでLlamaを動かせる

テキトー教師

テキトー教師この整理ができると、「自分のプロジェクトにどのLLMを使えばいいか」という判断がしやすくなりますよね。ChatGPTはLLMの入口として優秀ですが、LLMの世界はもっと広いです。

室谷

室谷.AIのコミュニティでも「LLMを選ぶ視点」というテーマでよく議論になります。最終的には「何をしたいか」によって最適なLLMが違うので、選択肢を知っておくことが大事です。

テキトー教師

テキトー教師今後もLLMは進化し続けますが、「テキストの文脈を理解して次の言葉を予測する」という基本原理は変わりません。根本を理解しておくと、新しいモデルが出てきたときも迷わずキャッチアップできます。

室谷

室谷「ChatGPT=LLM」という単純な理解から「ChatGPTはLLMを使ったサービスの1つ」という理解に変わると、AI活用の視野がぐっと広がります。ぜひここを起点に、色々なLLMを試してみてください。