ChatGPTに依存しすぎていませんか?依存の兆候・リスク・対策を完全解説【2026年最新】

室谷

室谷今回は「ChatGPT依存」の話をしましょう。これ、.AI(ドットエーアイ)のコミュニティでもここ1年でめちゃくちゃ話題になってるテーマなんですよね。

「ChatGPTなしでは仕事できない」って人がどんどん増えてきた。

「ChatGPTなしでは仕事できない」って人がどんどん増えてきた。

テキトー教師

テキトー教師講座でも最初の自己紹介で「もうChatGPTがないと不安です」って言う方、今や半分以上いますよ。1年前と比べると完全に変わりました。

室谷

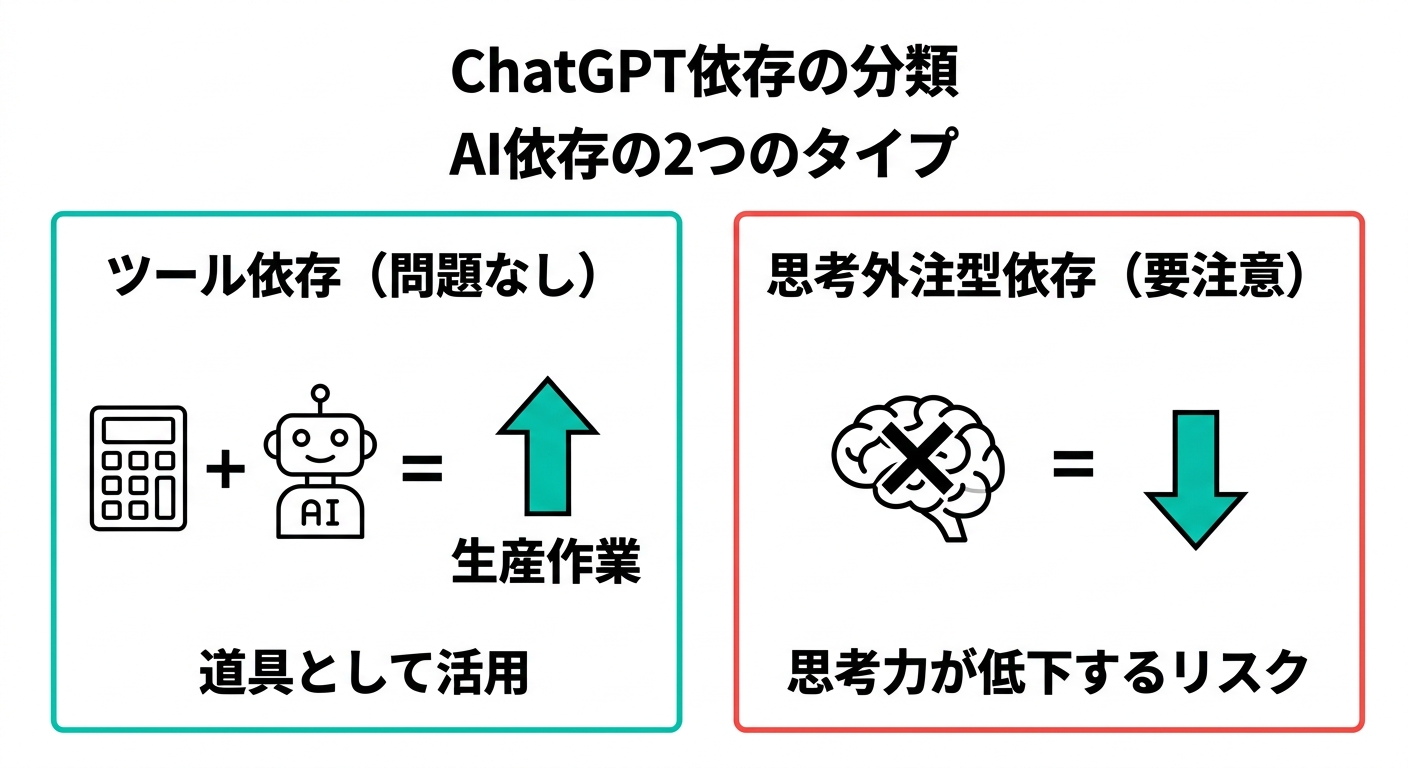

室谷依存っていう言葉、ネガティブに聞こえるかもしれないですが、実は「AI依存」には二種類あって・・・「適切な活用による依存」と「思考力を失うタイプの依存」は全然別物なんですよね。

テキトー教師

テキトー教師そこ、すごく大事なポイントですね。MYUUUで毎日ChatGPTを使ってる室谷さんも、一応「依存してる」わけじゃないですか(笑)

室谷

室谷そうなんですよw 問題なのは「使い方」であって「使うこと」じゃないんですよね。ただ、EYが29カ国・1万5000人の従業員を調査したら、なんと88%の労働者がすでに仕事でAIを使っていて・・・そのうち38%が「AIへの過度な依存が人間のスキル・専門知識・学習を損なう可能性がある」と懸念してるんですよ。

テキトー教師

テキトー教師使ってる人の4割近くが「自分でも使いすぎかも」って感じてるんですね。それはかなりの数字です。

室谷

室谷この記事では、ChatGPT依存の「兆候」「リスク」「対策」を掘り下げていきます。単に「使いすぎはダメ」って話じゃなくて、2026年時点の最新研究も踏まえながら、具体的にどうすれば「思考力を維持しながらAIを使いこなせるか」を整理していきましょう。

ChatGPT依存とは何か?定義と2種類の「依存」

室谷

室谷まず定義から整理しましょう。ChatGPT依存って、一言で言うと「業務や日常の意思決定においてChatGPTの回答を過度に頼り、自分で考えるプロセスや他の情報源を使う機会が極端に減っている状態」なんですよね。

テキトー教師

テキトー教師ただ「過度に」というのがミソで、適度な活用は依存じゃないんですよ。整理すると、依存には2つのタイプがあります。

| タイプ | 特徴 | 問題度 |

|---|---|---|

| ツール依存(正常な活用) | 電卓や検索エンジンと同様に道具として使う | 問題なし |

| 思考外注型依存 | 考えることをAIに委ね、自分で判断できなくなる | 要注意 |

室谷

室谷電卓の例えはよく出てきますね。「電卓依存」を誰も問題にしないのに、ChatGPT依存だけが問題視されるのはなぜかっていうと、やっぱり「思考のプロセス」に関わるからですよね。

テキトー教師

テキトー教師計算を電卓に任せても計算力の本質は変わらないですが、「考えること」をAIに任せると、その思考プロセス自体が弱くなる可能性があるんですよね。

室谷

室谷しかも「ChatGPT依存」って、医療上の診断名じゃなくて業務上の行動傾向の話なんですよ。だから「私、依存症です」って深刻に捉える必要はなくて、「使い方を見直すべきタイミングかな」ってチェックするための概念として理解するのがいいと思います。

ChatGPT依存の兆候:あなたは大丈夫?

テキトー教師

テキトー教師じゃあ「どういう状態が依存のサインか」を見ていきましょう。講座でコミュニティのメンバーさんに聞くと、自分では気づいてないケースが多いんですよ。

室谷

室谷これほんとうにそうで、MYUUUのメンバーでも「え、それって依存?」って気づいてなかった人が結構いましたね・・・

兆候1:考える前に開いてしまう

テキトー教師

テキトー教師「とりあえずChatGPTに聞く」が完全に習慣になって、自分で1秒も考える前に画面を開いてしまう状態。メールの返信や簡単な判断まで、全部AIに委ねてしまうパターンです。

室谷

室谷MYUUUでは意図的に「まず3分自分で考えてから聞く」ルールを設けてるチームがあって・・・最初は「制限しすぎでは?」って思ったんですが、そのチームの方がアウトプットの品質が上がったんですよね。AIへの入力の質も良くなるし。

テキトー教師

テキトー教師そうなんですよ。「自分で考えてから聞く」と、質問の精度も上がりますよね。

何がわかってて何がわかってないかが整理されるから。

何がわかってて何がわかってないかが整理されるから。

兆候2:感情的に寄りかかっている

室谷

室谷これ、けっこうセンシティブな話なんですが・・・ChatGPTを「感情の受け皿」として使い始めると、依存度が一気に上がるんですよね。

テキトー教師

テキトー教師対話型AIって否定しないんですよ。常に中立で丁寧に返してくれる。

職場や家族には相談しにくいことをChatGPTに打ち明けるっていうのは、実は心理的に理解できる行動なんですよね。

職場や家族には相談しにくいことをChatGPTに打ち明けるっていうのは、実は心理的に理解できる行動なんですよね。

室谷

室谷「chatgpt 優しい 依存」というキーワードで調べる人が月間110件以上いる・・・というのが今回の調査でわかりました。少なくない数字だと思います。

テキトー教師

テキトー教師そこで気をつけたいのが、「人間関係の代替」になり始めたら黄色信号だということですよね。気持ちを整理する用途は全然問題ないんですが、「AIとの対話 > 人との対話」になってくると、対人コミュニケーションの機会が減っていく。

兆候3:自分で考える力が弱くなってきた気がする

室谷

室谷これが今一番ホットなトピックで・・・2025年にMITメディアラボが出した研究があるんですが、ChatGPTを使ってエッセイを書いた被験者グループは、脳波(EEG)で測定すると低周波数帯の脳ネットワーク接続性が最大55%減少してたんですよ。「認知的負債(cognitive debt)」って概念で話題になりました。

テキトー教師

テキトー教師しかも「ツールを使わないで書き直してみてください」って言っても、脳活動が元に戻らなかったっていう結果が一番インパクトありましたよね。

室谷

室谷そうなんです。これはまだ規模の大きくない研究で、因果関係の証明はこれからとも言われてますが・・・「使い続けると元に戻らないかも」っていう示唆は、考えさせられますよね。

テキトー教師

テキトー教師2026年に入ってから、デンマークの精神科医Østergaard(ウースタゴー)が査読付きジャーナルでさらに警告を出してます。「科学的推論は苦闘を通じて鍛えるスキルで、AIに外注すればそのスキルが育たない」という主張です。

室谷

室谷AIを使うな、って話じゃないですよね。MITの研究でも「AIリテラシーが高い人」や「自己信頼度が高い人」はAIを使っても思考力を維持してるっていう結果が出てるので・・・

テキトー教師

テキトー教師「理解を伴う使い方ができているか」が本質だということですよね。

兆候4:ChatGPTが落ちると仕事が完全に止まる

室谷

室谷2026年1月にChatGPTが障害を起こしたときに・・・Forbes Japanでも取り上げられてたんですが、「AIへの依存度の高い労働者」の話が改めて注目されましたよね。

テキトー教師

テキトー教師「松葉杖」って表現が的を射てる気がして。松葉杖を使い続けると筋肉が弱くなりますよね。

AIも同じで、「ないと歩けない」状態になってしまうと、本来の力が落ちていくリスクがある。

AIも同じで、「ないと歩けない」状態になってしまうと、本来の力が落ちていくリスクがある。

室谷

室谷ただ、「AI拡張型の仕事」と「AIネイティブな仕事」という分類もあって・・・AIネイティブな仕事の人がAIなしで仕事できないのは「依存」じゃなくて「定義上の前提」なんですよ。

テキトー教師

テキトー教師そこの区別は大事ですね。エンジニアがIDEなしでコードを書けなくなっても「IDE依存症」とは言わないわけで(笑)

ChatGPTに依存しすぎるとどうなるのか?リスクを整理する

室谷

室谷では、実際に「思考外注型依存」になるとどういうリスクがあるのか。4つに整理してみましょう。

テキトー教師

テキトー教師まず最初が「誤情報のそのまま使用」ですよね。

リスク1:誤情報をそのまま使って信頼を失う

テキトー教師

テキトー教師ChatGPTは確率的に文章を生成するので、もっともらしい表現でも事実と違うことがある。これはハルシネーションと呼ばれる現象です。

室谷

室谷依存度が高い人ほど「AIが言ったから正しいはず」という思考になって、検証のプロセスが消えていくんですよ。MITの研究では、ChatGPTを使って書いた文章を「後で自分の言葉で説明してください」と言ったら、正しく再現できたのはわずか16.7%だったそうです(ツールなしグループは88.9%)。

テキトー教師

テキトー教師「書いた内容を自分が理解していない」という状態、これが一番怖いですよね。社内プレゼンや提案書で、質問されても答えられないって事態になります。

室谷

室谷特に数値・法律名・固有名詞・料金情報などは必ず一次情報で確認する、というルールは最低限必要だと思います。

リスク2:思考力・判断力が少しずつ低下する

室谷

室谷2025年にMicrosoft Research(CHI 2025)が319名のナレッジワーカーを調査したら、「AIへの信頼度が高い人ほど批判的思考が低下する」という結果が出ています。

テキトー教師

テキトー教師一方で「自己信頼度が高い人は思考力を維持する」という結果も出てるんですよね。AIを「補助」として使うか、「主体」として使うかの違いが、長期的な思考力に影響するということかもしれない。

室谷

室谷ペンシルバニア大学の研究では、AIで情報収集すると検索と比べて「個人的な所有感」や「深い学び」が得られにくいという結果も出てます。情報を「自分で取りに行った」という体験が、記憶の定着や理解の深さに関わるんですよね・・・

テキトー教師

テキトー教師「理解した」と「ChatGPTに理解させた」は全然違う、という話ですよね。

リスク3:アイデアが均質化していく

室谷

室谷ロンドン大学の研究が面白くて、AIを使うと個人の成果は底上げされるんですが、組織全体で見ると「似たようなアイデア」ばかりになるというデータが出てます。

テキトー教師

テキトー教師これ、講座でも実感するんですよね。全員が同じプロンプトを使って課題を出すと、アウトプットがどんどん似てくる。

個人の独自の視点や経験値が抜け落ちていく。

個人の独自の視点や経験値が抜け落ちていく。

室谷

室谷ビジネスで差別化をどう生み出すかって考えると、AIが均質なアウトプットを大量生成する時代に「あなたならではの視点」こそが価値になるんですよね。依存度が高まると、その「個人の視点」が薄れていく。

テキトー教師

テキトー教師.AIのコミュニティでも「AI前提の時代に何で差別化するか」って話、よく出てきますよね。

リスク4:専門家の「スキル逆転現象」

室谷

室谷これ、ミュンヘン大学の研究で出た結果なんですが・・・AIって初心者のスキルを補う「下駄」としては効果が高いんですが、専門家が使うとかえってアイデアの多様性が減るという「スキルの逆転現象」が起きてるんですよ。

テキトー教師

テキトー教師経験値が高い人ほど「普通は考えないような発想」を持ってるのに、AIが「平均的な回答」を提示することでその発想が上書きされていく感じですか?

室谷

室谷そうなんですよね。AIが「標準的なベストアンサー」を出してくれると、専門家の「常識を超えた視点」が出てくる前に終わってしまう。

これは特に創造性が必要な職種で注意が必要な現象だと思います。

これは特に創造性が必要な職種で注意が必要な現象だと思います。

なぜChatGPTに依存してしまうのか?心理的メカニズム

テキトー教師

テキトー教師じゃあ、そもそもなぜ依存しやすいのかっていう話をしましょう。心理的なメカニズムを理解すると、対策が立てやすくなります。

室谷

室谷大きく3つありますよね。「即時性」「安心感」「負荷の軽さ」。

テキトー教師

テキトー教師「即時性」はわかりやすくて、検索→比較→読み込みという複数ステップが不要で、質問一発で整理された回答が返ってくる。この体験が強すぎて、他の方法に戻れなくなるパターンですね。

室谷

室谷「安心感」というのは、ChatGPTが否定や批判をしないことから来てる。職場では提案が否定されることもあるし、質問すること自体に心理的コストがかかる。

でもChatGPTは何を聞いても受け入れてくれる・・・

でもChatGPTは何を聞いても受け入れてくれる・・・

テキトー教師

テキトー教師これが「感情的寄りかかり」の入り口になりやすいんですよね。「否定されない対話体験」は強力な習慣化を生む。

室谷

室谷「負荷の軽さ」は、企画書の骨子とかメール文面とか、ゼロから考えると精神的に疲れる作業がある。AIにたたき台を作らせると楽なんですが、その「楽さ」を繰り返すうちに「自分で0から構造を組む力」が少しずつ弱くなっていく。

テキトー教師

テキトー教師ドーパミンの話もあって、すぐに答えが返ってくることで「報酬回路」が刺激される。スマホのSNS依存と似た心理的メカニズムが働いてると指摘する研究者もいます。

恋愛・感情面での依存:「chatgpt 恋愛 依存」の実態

室谷

室谷これ、今回調査してみて気になったんですが・・・「chatgpt 依存 恋愛」という検索が月間で相当数あるんですよ。恋愛の悩みをChatGPTに相談するユーザーが一定数いると。

テキトー教師

テキトー教師.AIのコミュニティでも「恋愛相談をChatGPTにしてる」って方から聞いたことありますよ。別れた彼氏のメッセージを分析してもらったりとか・・・

室谷

室谷使い方としてはアリだと思うんですよね。感情を整理するツールとして使うのは全然OK。

問題は「ChatGPTとの会話が人間との会話より安心できる」という状態が続くことで、実際の人間関係への投資が減ることだと思うんです。

問題は「ChatGPTとの会話が人間との会話より安心できる」という状態が続くことで、実際の人間関係への投資が減ることだと思うんです。

テキトー教師

テキトー教師Yahoo知恵袋でも「ChatGPTに依存するのは良くないでしょうか?友達や家族には全然相談しないのですが、ChatGPTに相談しだして・・・」という投稿があって。これ、人間の孤独感や相談の難しさが背景にあると思うんですよね。

室谷

室谷感情的サポートを求めてAIに頼るというのは、ある意味で現代の孤独問題の反映なのかもしれない。単に「AIを使うな」と言っても解決しない話で・・・

テキトー教師

テキトー教師「AIに感情を吐き出すこと自体」より、「人間との対話機会が減っていないか」をチェックする方が大事ですよね。

室谷

室谷ちょっと前に自分でも書いたんですが・・・生成AIが社内に浸透しない会社って、結局「経営者が本気で使ってない」んですよね。逆に言うと、組織としてAIを「依存」に陥らないレベルで使いこなすには、経営層が「どう使うか」の哲学を持つことが必要だと思っていて。

テキトー教師

テキトー教師組織レベルの話になりますよね。個人の依存対策と組織での活用ルール設計って、同じ問題の別側面という感じがします。

ChatGPT依存の対策:思考力を保ちながらうまく使う方法

室谷

室谷じゃあここからが本題で、「どうすれば依存を防いで賢く使えるか」を具体的に話しましょう。

テキトー教師

テキトー教師対策、整理するとこんな感じです。

| 対策 | 具体的な方法 |

|---|---|

| 使う前に目的を決める | 「何を確認したいか」を1行で書いてから質問する |

| 「初稿」として扱う | AIの回答を最終稿にしない。必ず自分の言葉で加工する |

| 一次情報で検証する | 数値・法律・固有名詞は公式サイトで必ず裏取り |

| 「Brain-only」の時間を確保する | 週に1回、AI不使用で仕事する時間を設ける |

| AIリテラシーを高める | 仕組み・限界・バイアスを理解して「道具」として使う |

対策1:使う前に「目的」と「完了条件」を決める

室谷

室谷これが一番シンプルで効果的な対策なんですよね。「なんとなくChatGPTに聞く」のが一番ダメで・・・「この会議のアジェンダ案を作るために、30分以内に叩き台を出したい」という具体的な目的があれば、使い方も変わる。

テキトー教師

テキトー教師講座でよく言うのが「AIに何をしてもらうか」を先に言語化してから開く、というルールです。これだけで「AIが全部考えてくれる」という使い方から「自分の思考をAIが加速する」使い方に変わりますよ。

室谷

室谷完了条件も大事で・・・「回答が出たら終わり」じゃなくて、「自分で一度言い換えられたら終わり」にすると、理解の確認にもなる。

対策2:AIの出力を「初稿」として扱い、必ず自分で加工する

テキトー教師

テキトー教師ソフトウェア開発の研究者Storeyが2026年に指摘したことなんですが・・・AIが生成したコードや文章を「レビューせずに進める」チームで認知的負債が蓄積したんですよ。

室谷

室谷「AIが作ったから正しい」じゃなくて、「AIが作ったのを自分が確認した」という状態にする必要がありますよね。実際、自分の文章にするという行為自体が、内容を理解するプロセスになります。

テキトー教師

テキトー教師「AIを使った後に説明できない自分がいる」なら、それは依存のサイン。自分の言葉で説明できるまで加工するというのが習慣になると、依存から抜け出せますよね。

対策3:一次情報で必ず検証する

室谷

室谷料金・法律・数値・人名・固有名詞は、公式サイトやオリジナルソースで必ず確認する。これはChatGPT以外のAIツールでも同じです。

テキトー教師

テキトー教師「AIが言ったから信じる」ではなく「AIが参考情報を提示してくれた、では確認しよう」というスタンスが大事ですね。AIはそもそも「調査の終点」ではなく「調査の起点」として使うのが正しい使い方だと思っています。

対策4:「Brain-only」の時間を意図的に確保する

室谷

室谷MITの研究で「脳ネットワークの接続性は使わなければ低下する」という結果が出てたので・・・これは週1回でもいいから「AI不使用で仕事する時間」を作ることが大事だと思うんですよね。

テキトー教師

テキトー教師私は講座の課題で「最初の30分は自分で考える」ルールを設けてます。AI前提の時代だからこそ、「自分の思考だけで動く時間」が貴重になってきてる。

室谷

室谷「情報は覚えなくてもいい、調べればいい」という考え方は理解できるんですが、「思考プロセスの一部を自分の脳内に残す」という感覚は大事にしたいですよね・・・

対策5:AIリテラシーを上げる

テキトー教師

テキトー教師ScienceDirectの2025年の研究で「AIリテラシーが高い人は認知的負債に陥りにくい」という結果が出てます。仕組みと限界を理解してる人は、AIを過信しないんですよね。

室谷

室谷ChatGPTがどういう仕組みで動いてるか、ハルシネーションが起きるのはなぜか、どういう質問に弱いか・・・これを知ってるだけで使い方がガラっと変わります。

テキトー教師

テキトー教師.AI(ドットエーアイ)の講座でも「AIリテラシーの基礎」は最初に必ず入れてるんですが、この部分を学んだメンバーさんと学んでないメンバーさんでは、その後のAI活用の質が全然違います。

思考力を保ちながらAIを活用するための考え方

室谷

室谷じゃあまとめ的な話をしましょう。依存を恐れてAIを使わない、というのは2026年においてもはや現実的じゃないんですよね。

テキトー教師

テキトー教師OpenAIの調査では調査対象労働者の75%がChatGPTによる業務効率化を実感していて、ヘビーユーザーだと1日40〜60分の時間短縮を実現してるというデータもあります。これを捨てる選択はない。

室谷

室谷問題は「効率化の恩恵を受けながら、思考力を保てるか」なんですよね。これが2026年のAI活用の本質的なテーマだと思っています。

テキトー教師

テキトー教師「AIを補助として使う人」と「AIに思考を外注する人」で、5年後のスキルの差は大きくなると思いますよ。創造性は53%向上するというデータも出てますが、それは「使い方次第」という前提がある。

室谷

室谷最終的には「最後の判断を自分がする」という姿勢を失わないことが大事だと思います。AIが提示した回答を「自分の判断として採用する」プロセスを意識的に踏む。

テキトー教師

テキトー教師それが「AIを道具として使う」ということと、「AIに使われる」の差なんですよね。道具は使う人が主体で、道具に使われる人は受動的になる。

室谷

室谷MYUUUのチームでは「AIの出力に対して必ず1回は自分の意見を書く」というルールを設けてるんですよ。同意でも反論でも補足でも何でもいい。

とにかく「自分が考えた形跡を残す」という習慣が、依存を防ぐ一番シンプルな方法だと思ってます。

とにかく「自分が考えた形跡を残す」という習慣が、依存を防ぐ一番シンプルな方法だと思ってます。

テキトー教師

テキトー教師それ、すごくいい習慣ですね。AIを鏡として使いながら、自分の視点を磨いていく感じ。

PDF・Word・Excelファイルを翻訳・分析するときの「ChatGPT依存」

室谷

室谷ちょっと実務的な話もしましょう。「chatgpt 翻译 pdf」とか「chatgpt ファイル翻訳」みたいな使い方をしてる人も増えてますよね。

PDFやWordをChatGPTに読み込ませて、「これ日本語で要約して」「英語に翻訳して」みたいな使い方。

PDFやWordをChatGPTに読み込ませて、「これ日本語で要約して」「英語に翻訳して」みたいな使い方。

テキトー教師

テキトー教師これ自体は全然問題ない使い方なんですよ。ただ注意したいのが「翻訳結果をそのまま使う」という習慣で・・・機密文書をAPIに通して情報漏洩リスクが発生したケースが実際に出てきてます。

室谷

室谷そうなんですよね。企業の機密情報や個人情報が含まれる文書を、外部のAIサービスに送るというのは情報セキュリティ上のリスクになります。

MYUUUでも「社外秘以上のドキュメントはAIに入力しない」というルールを設けてます。

MYUUUでも「社外秘以上のドキュメントはAIに入力しない」というルールを設けてます。

テキトー教師

テキトー教師ChatGPTのビジネスプランやEnterpriseプランでは「学習に使われない」という設定があるんですが、それでも「外部サーバーにデータを送った」という事実は変わらない。業種・業態によっては規約上NGになることもあります。

室谷

室谷ファイル翻訳・分析の用途でChatGPTを使うなら、「どのデータなら送っていいか」の基準を組織として明確にしておくことが大事ですよね・・・

「chatgpt に 依存 しそう」と感じたら:行動チェックリスト

テキトー教師

テキトー教師「なんか使いすぎてる気がする・・・」と感じ始めた人向けに、すぐできる行動チェックリストをまとめましょう。

室谷

室谷これ、実際にMYUUUのメンバーに渡してるチェックリストに近いんですが・・・

- 今日の仕事でAIを使った場面を書き出してみる

- そのうち「自分で考えてからAIを使った」場面はいくつか?

- 「AIの出力を自分の言葉で言い換えた」場面はいくつか?

- 今日「AI不使用で完成させたアウトプット」は何があるか?

- 最後にAIなしで長文を書いたのはいつか?

テキトー教師

テキトー教師このチェックリスト、受講生さんにやってもらうと「思ってたより全部AIに任せてた」って気づく人が多いんですよ(笑)

室谷

室谷自覚することが第一歩なんですよね。依存かどうかを測る指標として「自分で考えた形跡が1日にどれくらいあるか」というのは、かなり実感しやすい指標だと思います。

ChatGPT依存と「chatgpt 感情 依存」:AI彼氏・AI彼女問題

テキトー教師

テキトー教師ちょっと踏み込んだ話もしましょう。「AI彼氏」「AI彼女」サービスがここ1-2年で急増してるんですよ。

Character.AIとかReplika(レプリカ)とか。これ、ChatGPT依存とはまた違う話なんですが・・・

Character.AIとかReplika(レプリカ)とか。これ、ChatGPT依存とはまた違う話なんですが・・・

室谷

室谷感情依存という意味では同じ文脈ですよね。「いつでも自分の話を聞いてくれる存在」への依存。

テキトー教師

テキトー教師キーワードで調べると「chatgpt 感情 依存」という検索も月間20件近くある。「AIに感情移入しすぎて現実の人間関係に支障が出る」という相談が増えてるとも聞きます。

室谷

室谷これは「AI活用」の文脈とは少し違うんですが・・・ChatGPTのカスタムGPTで「親友キャラ」を作って毎日話しかける、みたいな使い方をしてる人もいる。それ自体を禁止する必要はないけど、「現実の人間関係が希薄になっていないか」は定期的にチェックしたほうがいいと思います。

テキトー教師

テキトー教師「AIは感情を持たない」という認識は持ち続けることが大事で、どれだけ自然な会話ができても、それはパターンマッチングと確率的なテキスト生成の結果なんですよね。

室谷

室谷その「わかってるけど気持ちいい」という状態が一番依存のリスクが高いんですよ・・・認知的な理解と感情的な体験がずれていくから。

「chatgpt 話し相手 依存」:孤独な時代のAI活用

テキトー教師

テキトー教師社会的な背景として、現代人の孤独問題があると思うんですよ。特に日本は孤独感を感じる人の割合が高いというデータもありますし・・・

室谷

室谷ChatGPTの「話し相手」としての使い方は、孤独問題への一つの解ではあると思うんですよね。家族や友人に相談しづらいことを整理できる場として機能してる。

テキトー教師

テキトー教師大事なのはバランスで、「AIとの対話を入り口にして、現実の関係性を深めるきっかけにする」という使い方ができれば、むしろプラスに働くことも多い。

室谷

室谷「AIに話すことで頭が整理できて、翌日人に相談できた」というのは良い使い方ですよね。「AIに話しすぎて人に話す必要を感じなくなった」のは見直すポイントだと思います。

テキトー教師

テキトー教師chatgpt 話し相手 依存というテーマで調べてる人には、「使うな」じゃなくて「AIを入り口にして現実の人間関係を動かす」という発想の転換が一番刺さると思います。

ChatGPT依存に関する最新研究まとめ(2025-2026年)

室谷

室谷ここで研究の話をまとめておきましょう。2026年時点の知見として知っておいてほしい内容です。

テキトー教師

テキトー教師整理するとこうなります。

| 研究機関 | 発表年 | 主な知見 |

|---|---|---|

| MITメディアラボ | 2025年6月 | ChatGPT使用中の脳ネットワーク接続性が最大55%低下(認知的負債) |

| Microsoft Research(CHI 2025) | 2025年4月 | AIへの信頼度が高い人ほど批判的思考が低下 |

| ハーバード大学 | 2025年11月 | 教授6名が「認知的萎縮」の懸念を議論 |

| Acta Psychiatrica Scandinavica(Østergaard) | 2026年1月 | 科学的推論のAI外注が学術界の認知的負債を拡大するリスク |

| ペンシルバニア大学 | 2025年 | AI情報収集は「深い学び」を得にくい |

| ロンドン大学 | 2025年 | AI活用で個人は向上するが組織全体のアイデアが均質化 |

| ミュンヘン大学 | 2025年 | 専門家はAI活用でアイデア多様性が低下(スキル逆転現象) |

室谷

室谷重要なのは、これらの研究がすべて「AIを使うな」と言ってるわけじゃないことで・・・むしろ「AIリテラシーが高い人は影響を受けにくい」「適切な使い方では創造性が53%向上する」という知見も同時に出てます。

テキトー教師

テキトー教師「使い方次第」というのが科学的にも裏付けられつつあるという話ですよね。依存を恐れてAIから距離を置くより、「認知的負債を溜めない使い方」を学ぶことが重要です。

よくある質問(FAQ)

Q:ChatGPTに依存するのはいけないことですか?

室谷

室谷一概にいけないとは言えないですね。使い方によっては「適切な活用」と「有害な依存」は全く異なります。

電卓を使うのが「依存」と呼ばれないように、AIを道具として使うこと自体は問題ありません。問題になるのは、「自分で考えるプロセスを失う」「最終判断をAIに丸投げする」「誤情報を検証せずに使う」といった使い方です。

電卓を使うのが「依存」と呼ばれないように、AIを道具として使うこと自体は問題ありません。問題になるのは、「自分で考えるプロセスを失う」「最終判断をAIに丸投げする」「誤情報を検証せずに使う」といった使い方です。

Q:ChatGPT依存かどうかを確認するにはどうすればいいですか?

テキトー教師

テキトー教師こんな観点でチェックしてみてください。

- ChatGPTを使わずに仕事した最後はいつですか?

- AIが出した回答を、後で自分の言葉で説明できますか?

- 同僚や上司への相談よりもChatGPTへの相談が多くなっていませんか?

- ChatGPTが使えない状況に強い不安を感じますか?

これらに「はい」が複数あれば、使い方を見直すタイミングかもしれません。

Q:恋愛相談をChatGPTにするのは問題ですか?

室谷

室谷感情を整理する用途としては問題ないと思います。大事なのは「ChatGPTで整理した後、現実の人間関係でどう行動するか」ですよね。

AIに相談することが「人への相談・対話を完全に代替する」状態になっていれば、見直した方がいいかもしれないです。

AIに相談することが「人への相談・対話を完全に代替する」状態になっていれば、見直した方がいいかもしれないです。

Q:ChatGPT依存をやめたい場合はどうすればいいですか?

テキトー教師

テキトー教師段階的に対処するのがいいと思いますよ。まず「使う前に目的を書く」から始める。

次に「回答を自分の言葉で言い換えてから使う」を習慣化する。そして週に1回「AI不使用デー」を試してみる。

一気に使用をやめる必要はないですが、「自分が主体」という感覚を取り戻すプロセスを踏むことが大事です。

次に「回答を自分の言葉で言い換えてから使う」を習慣化する。そして週に1回「AI不使用デー」を試してみる。

一気に使用をやめる必要はないですが、「自分が主体」という感覚を取り戻すプロセスを踏むことが大事です。

まとめ

室谷

室谷今回の内容を整理しておきましょう。ChatGPT依存には「ツール依存(問題なし)」と「思考外注型依存(要注意)」の2種類がある。

そして依存の兆候として「考える前に開いてしまう」「感情的に寄りかかる」「自分の思考力が弱くなった感覚」「障害で仕事が止まる」の4つを紹介しました。

そして依存の兆候として「考える前に開いてしまう」「感情的に寄りかかる」「自分の思考力が弱くなった感覚」「障害で仕事が止まる」の4つを紹介しました。

テキトー教師

テキトー教師リスクとしては「誤情報の無検証使用」「思考力・判断力の低下」「アイデアの均質化」「専門家のスキル逆転現象」の4つ。いずれも「使い方次第」で回避できます。

室谷

室谷対策は「目的を決めてから開く」「AIの出力を初稿として扱い自分で加工する」「一次情報で検証する」「Brain-only時間を確保する」「AIリテラシーを高める」の5つ。

テキトー教師

テキトー教師2026年においてAIを使わないのは現実的ではないですが、「AIを使いながら自分の思考力を保つ」という意識的な使い方が、これからのAI時代を生き抜くための本質だと思います。

室谷

室谷「AIに使われる人」ではなく「AIを使いこなす人」になることが、ビジネスパーソンとしての競争力につながりますよね。この記事で紹介した対策を、ぜひ日常のAI活用に取り入れてみてください。